脑-机接口:原理与实践

1

2017

... 人们在日常生活和交流中,通常通过面部表情、语音对话、肢体语言等外部行为信号识别周围人的情绪,从而实现带有情感的自然的交流与互动.如何让机器也能像人一样对人的情绪进行实时、准确的判别,并在此基础上进行更加自然、友好的人机交互,是情感智能(emotion artificial intelligence)或情感计算(affective computing)研究的重要目标之一.情感脑机接口(affective brain computer interface,aBCI)是情感智能的一个分支,也是目前实现情感智能研究目标的重要途径[1]. ...

脑-机接口:原理与实践

1

2017

... 人们在日常生活和交流中,通常通过面部表情、语音对话、肢体语言等外部行为信号识别周围人的情绪,从而实现带有情感的自然的交流与互动.如何让机器也能像人一样对人的情绪进行实时、准确的判别,并在此基础上进行更加自然、友好的人机交互,是情感智能(emotion artificial intelligence)或情感计算(affective computing)研究的重要目标之一.情感脑机接口(affective brain computer interface,aBCI)是情感智能的一个分支,也是目前实现情感智能研究目标的重要途径[1]. ...

Brain- computer interfaces:revolutionizing human-computer interaction

1

2010

... 情感脑机接口是一种对人的情绪进行识别和(或)调控的脑机接口.由于情绪的复杂性,相比运动脑机接口(如运动想象脑机接口),情感脑机接口面临更多的挑战[2,3,4].情感脑机接口研究面临的困难和研究现状可归纳为以下3个方面:①相对于记忆、学习等大脑的基本功能,神经科学对情绪产生的神经机理和神经回路了解甚少,缺乏有效的技术手段从系统层面对动物模型的情绪开展客观、定量的研究;②从人工智能的发展过程来看,情感智能的研究在近期才得到学术界和工业界的关注,情感脑机接口的研究相对起步较晚;③国内外从事情感脑机接口研究的实验室和团队相对较少,研究论文和专著的数目远远少于运动脑机接口. ...

Brain-machine interfaces from motor to mood

4

2019

... 情感脑机接口是一种对人的情绪进行识别和(或)调控的脑机接口.由于情绪的复杂性,相比运动脑机接口(如运动想象脑机接口),情感脑机接口面临更多的挑战[2,3,4].情感脑机接口研究面临的困难和研究现状可归纳为以下3个方面:①相对于记忆、学习等大脑的基本功能,神经科学对情绪产生的神经机理和神经回路了解甚少,缺乏有效的技术手段从系统层面对动物模型的情绪开展客观、定量的研究;②从人工智能的发展过程来看,情感智能的研究在近期才得到学术界和工业界的关注,情感脑机接口的研究相对起步较晚;③国内外从事情感脑机接口研究的实验室和团队相对较少,研究论文和专著的数目远远少于运动脑机接口. ...

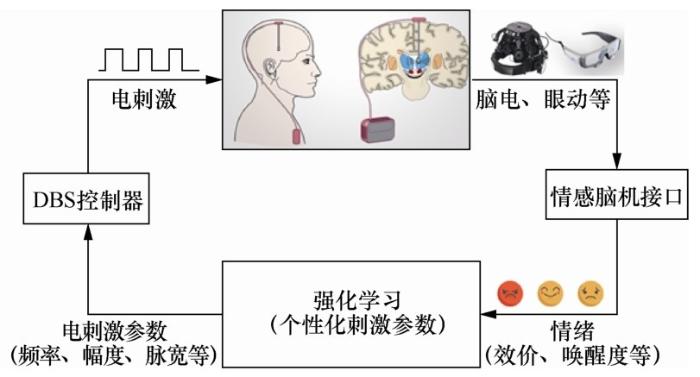

... 从图1可以看出,情绪识别脑机接口的结构(图1虚线框内部分)与运动脑机接口类似,人的大脑在整个系统中的作用是担当控制器(controller)[3],系统的目标是对人的情绪进行解码,或称其为情绪识别.从系统的角度来看,情绪识别脑机接口的结构是一个开环系统. ...

... 在上述情绪识别脑机接口的基础上结合调控回路(图1绿线部分)即可组成情绪调控脑机接口.情绪调控脑机接口与情绪识别脑机接口,在以下两方面有着根本的区别.①在情绪调控脑机接口中,人的大脑由控制器转变为一种装置(plant)[3].而控制器由两部分构成,一是情绪解码系统,二是情绪解码后对大脑施加刺激的情绪调控系统.②情绪调控脑机接口是一个闭环系统,情绪解码之后紧接着需要对大脑施加相应的刺激,以实现情绪调控. ...

... Shanechi M M[3]对运动脑机接口和情感脑机接口的特点进行了系统的分析和比较,总结了情感脑机接口面临的主要挑战.首先,从脑电信号获取的角度来说,情绪关联着分布式多点皮层网络,并且其职能尚未有明确定义.其次,从行为观测的角度来说,情绪一般按照情绪种类呈现离散化分布,并且情绪的动态变化频率较低.同时,在行为时间上,一种情绪可能持续数分钟至数天或更长.另外,从状态评估的角度来说,情绪评估往往面临的难度更大.常见评估方法是自我评估量表,通常准确性较低.理论上讲,情绪很难找到金标准,原因是每个人实际上都无法准确地定量描述自己的情绪.应用情感脑机接口进行情绪调控,需要充分理解脑刺激的效果,即对电刺激和大脑反应之间的关系进行建模.由于情绪关联着分布式多点皮层网络,建模过程面临更大的挑战. ...

Ten challenges for EEG-based affective computing

2

2019

... 情感脑机接口是一种对人的情绪进行识别和(或)调控的脑机接口.由于情绪的复杂性,相比运动脑机接口(如运动想象脑机接口),情感脑机接口面临更多的挑战[2,3,4].情感脑机接口研究面临的困难和研究现状可归纳为以下3个方面:①相对于记忆、学习等大脑的基本功能,神经科学对情绪产生的神经机理和神经回路了解甚少,缺乏有效的技术手段从系统层面对动物模型的情绪开展客观、定量的研究;②从人工智能的发展过程来看,情感智能的研究在近期才得到学术界和工业界的关注,情感脑机接口的研究相对起步较晚;③国内外从事情感脑机接口研究的实验室和团队相对较少,研究论文和专著的数目远远少于运动脑机接口. ...

... 上述离散模型和维度模型在情感脑机接口中被广泛应用.但值得注意的是,最近的心理学相关研究指出了这些传统模型的局限性[4].一方面,维度模型中正面和负面情绪被描述为互斥关系,但人类日常生活中存在快乐和悲伤共同出现的情绪,例如大学毕业的时刻[8],维度模型无法很好地描述这种情绪.另一方面,近年来发展的积极心理学理论指出,传统的情绪理论对于正面情绪的复杂性考虑不足,实际上人们在日常生活中可以体验到多种复杂的积极情绪,包括喜悦、感激、兴趣、希望、骄傲、娱乐、灵感和爱心等[9].因此,情感脑机接口研究的重要挑战是如何结合心理学、认知科学等学科的最新研究进展,建立更完备和精细的情绪模型,从而实现更自然的情感交互. ...

情感脑-机接口

3

2021

... 情绪是在外界刺激条件下人的复杂的生理物理变化过程,具有 3 种成分:主观体验,即人对于不同情绪的自我感受;外部表现,即人处在不同情绪时身体各部分动作的量化反应形式;生理唤醒,即由情绪的变化引起的生理信号的变化[5]. ...

... 具体而言,对脑电信号的处理和分析流程一般包括预处理、特征提取、特征平滑、训练分类器和测试等[5,16].由于脑电信号非常微弱,在采集过程中非常容易受到人体自身的其他生理信号以及外界环境的干扰,所以首先需要对脑电信号进行预处理,去除包括眼电伪迹、肌电伪迹、心电伪迹、皮肤电活动干扰、工频干扰等噪声与干扰. ...

... 人工智能追求的终极目标是让机器能像人一样学习、思考和具有情感.根据目前神经科学、认知科学、计算机科学和人工智能的发展水平,要实现像人一样的情感至少需要经历4个阶段[5].第一阶段,大多数人工智能系统仅具有逻辑智能,而不具备任何情感智能.第二阶段,机器能精确识别人的情绪并进行情感反馈.第三阶段,机器具有自主学习能力并对客观世界有全面的感知和认知.第四阶段,机器具有价值观、意识和创造性,形成自我,具有像人一样的情感,从而具有与人进行自然情感交互的能力.目前人工智能的研究水平正在从第一阶段迈向第二阶段.而在通用人工智能发展过程中,情感脑机接口将发挥重要的作用,因为它是能够使未来机器人精确地识别人的情绪的关键技术. ...

情感脑-机接口

3

2021

... 情绪是在外界刺激条件下人的复杂的生理物理变化过程,具有 3 种成分:主观体验,即人对于不同情绪的自我感受;外部表现,即人处在不同情绪时身体各部分动作的量化反应形式;生理唤醒,即由情绪的变化引起的生理信号的变化[5]. ...

... 具体而言,对脑电信号的处理和分析流程一般包括预处理、特征提取、特征平滑、训练分类器和测试等[5,16].由于脑电信号非常微弱,在采集过程中非常容易受到人体自身的其他生理信号以及外界环境的干扰,所以首先需要对脑电信号进行预处理,去除包括眼电伪迹、肌电伪迹、心电伪迹、皮肤电活动干扰、工频干扰等噪声与干扰. ...

... 人工智能追求的终极目标是让机器能像人一样学习、思考和具有情感.根据目前神经科学、认知科学、计算机科学和人工智能的发展水平,要实现像人一样的情感至少需要经历4个阶段[5].第一阶段,大多数人工智能系统仅具有逻辑智能,而不具备任何情感智能.第二阶段,机器能精确识别人的情绪并进行情感反馈.第三阶段,机器具有自主学习能力并对客观世界有全面的感知和认知.第四阶段,机器具有价值观、意识和创造性,形成自我,具有像人一样的情感,从而具有与人进行自然情感交互的能力.目前人工智能的研究水平正在从第一阶段迈向第二阶段.而在通用人工智能发展过程中,情感脑机接口将发挥重要的作用,因为它是能够使未来机器人精确地识别人的情绪的关键技术. ...

An argument for basic emotions

1

1992

... 人的情绪会受到时间、地理、文化以及个体差异等因素的影响.目前,研究人员主要关注两类情绪模型:离散模型和维度模型.离散模型认为情绪是由多种不同的、离散的基本情绪组成的,其余的情绪是这些基本情绪的组合,人的真实情绪包含这些基本情绪以及其他复杂情绪.离散模型中比较著名的是Ekman P提出的情绪理论[6]. ...

A circumplex model of affect

1

1980

... 维度模型则把情绪定义在由多个维度组成的坐标系中,其中被广泛使用的是Russell J A于1980年提出的情绪二维模型[7],它将人类的所有情绪描述在由效价(valence)和唤醒度(arousal)建立的二维坐标系中.所有情绪可以由该二维坐标系中的一个点坐标表示.通过使用维度的方法,人们可以更具体地评估和量化刺激引发的情绪反应. ...

Can people feel happy and sad at the same time?

1

2001

... 上述离散模型和维度模型在情感脑机接口中被广泛应用.但值得注意的是,最近的心理学相关研究指出了这些传统模型的局限性[4].一方面,维度模型中正面和负面情绪被描述为互斥关系,但人类日常生活中存在快乐和悲伤共同出现的情绪,例如大学毕业的时刻[8],维度模型无法很好地描述这种情绪.另一方面,近年来发展的积极心理学理论指出,传统的情绪理论对于正面情绪的复杂性考虑不足,实际上人们在日常生活中可以体验到多种复杂的积极情绪,包括喜悦、感激、兴趣、希望、骄傲、娱乐、灵感和爱心等[9].因此,情感脑机接口研究的重要挑战是如何结合心理学、认知科学等学科的最新研究进展,建立更完备和精细的情绪模型,从而实现更自然的情感交互. ...

Positive emotions broaden and build

1

2013

... 上述离散模型和维度模型在情感脑机接口中被广泛应用.但值得注意的是,最近的心理学相关研究指出了这些传统模型的局限性[4].一方面,维度模型中正面和负面情绪被描述为互斥关系,但人类日常生活中存在快乐和悲伤共同出现的情绪,例如大学毕业的时刻[8],维度模型无法很好地描述这种情绪.另一方面,近年来发展的积极心理学理论指出,传统的情绪理论对于正面情绪的复杂性考虑不足,实际上人们在日常生活中可以体验到多种复杂的积极情绪,包括喜悦、感激、兴趣、希望、骄傲、娱乐、灵感和爱心等[9].因此,情感脑机接口研究的重要挑战是如何结合心理学、认知科学等学科的最新研究进展,建立更完备和精细的情绪模型,从而实现更自然的情感交互. ...

Neuroimaging of cerebral activations and deactivations associated with hypercapnia and hunger for air

1

2001

... 神经影像是研究人类情绪的重要手段之一.研究者利用断层扫描和功能磁共振等手段观察人类在不同情绪下大脑的变化,探究情绪解剖学的机理与关联.例如许多研究发现,杏仁核在及早自动发现环境中的威胁和危险以及触发恐惧/焦虑体验方面发挥作用[10,11].类似地,与正面情绪相关的研究发现,幸福感和奖惩机制与基底神经节(腹侧纹状体和壳状核)激活相关[12]. ...

Classical fear conditioning in functional neuroimaging

1

2000

... 神经影像是研究人类情绪的重要手段之一.研究者利用断层扫描和功能磁共振等手段观察人类在不同情绪下大脑的变化,探究情绪解剖学的机理与关联.例如许多研究发现,杏仁核在及早自动发现环境中的威胁和危险以及触发恐惧/焦虑体验方面发挥作用[10,11].类似地,与正面情绪相关的研究发现,幸福感和奖惩机制与基底神经节(腹侧纹状体和壳状核)激活相关[12]. ...

Functional neuroanatomy of emotion:a meta-analysis of emotion activation studies in PET and fMRI

1

2002

... 神经影像是研究人类情绪的重要手段之一.研究者利用断层扫描和功能磁共振等手段观察人类在不同情绪下大脑的变化,探究情绪解剖学的机理与关联.例如许多研究发现,杏仁核在及早自动发现环境中的威胁和危险以及触发恐惧/焦虑体验方面发挥作用[10,11].类似地,与正面情绪相关的研究发现,幸福感和奖惩机制与基底神经节(腹侧纹状体和壳状核)激活相关[12]. ...

Imaging human emotions and affective feelings:implications for biological psychiatry

1

2004

... 上述关于情绪的研究主要侧重解剖方面,通过动物实验,神经科学家可以进一步研究情绪产生和变化的神经机理和因果关系.目前,已经在哺乳动物大脑皮层下区域发现了一些核心情感系统,如基于多巴胺的促进积极觅食的搜寻系统,基于杏仁核、末端纹状体的床核传播网络的焦虑情绪相关系统等[13]. ...

Facial expressions of emotion states and their neuronal correlates in mice

1

2020

... 但关于动物究竟是否拥有类似于人的情绪体验以及如何定义动物的情绪的基本问题,学界尚未有明确的共识.2020年德国马普所的研究团队发表在《科学》期刊上的文章研究了小鼠的6种情绪[14].该研究发现,小鼠在6种外界刺激下会展现出相应的面部表情,并在岛状皮质区域检测到相关的神经元活动.这种面部表情的变化在强度、效价、持久性上均表现出与情绪相似的特性.这一发现是动物情绪模型研究的一项具有里程碑意义的突破.结合物种之间的同源性,将人类影像学的研究发现和动物实验的发现结合,有望帮助人们加速对人类自身情绪神经机理探索的进程,从而为情感脑机接口的研究提供神经生理学的支撑. ...

面向脑电数据的知识建模和情感识别

1

2015

... 脑电图(electroencephalography,EEG)是情感脑机接口使用最广泛的一种生理信号[15,16,17].目前,常用的脑电采集设备有湿电极和干电极两种.从信号质量的角度来看,湿电极普遍优于干电极,但干电极的优点是佩戴方便,适合普通人使用. ...

面向脑电数据的知识建模和情感识别

1

2015

... 脑电图(electroencephalography,EEG)是情感脑机接口使用最广泛的一种生理信号[15,16,17].目前,常用的脑电采集设备有湿电极和干电极两种.从信号质量的角度来看,湿电极普遍优于干电极,但干电极的优点是佩戴方便,适合普通人使用. ...

基于生理信号的情感计算研究综述

4

2021

... 脑电图(electroencephalography,EEG)是情感脑机接口使用最广泛的一种生理信号[15,16,17].目前,常用的脑电采集设备有湿电极和干电极两种.从信号质量的角度来看,湿电极普遍优于干电极,但干电极的优点是佩戴方便,适合普通人使用. ...

... 具体而言,对脑电信号的处理和分析流程一般包括预处理、特征提取、特征平滑、训练分类器和测试等[5,16].由于脑电信号非常微弱,在采集过程中非常容易受到人体自身的其他生理信号以及外界环境的干扰,所以首先需要对脑电信号进行预处理,去除包括眼电伪迹、肌电伪迹、心电伪迹、皮肤电活动干扰、工频干扰等噪声与干扰. ...

... 目前,在情感脑机接口研究中使用较为广泛[16]的两个数据集分别是DEAP数据集[32]和SEED数据集[22].DEAP数据集包括32名被试的32通道的脑电数据,以及其他生理信号(眼电、肌电、皮肤电反应、呼吸、血液体积压力、皮肤温度、面部视频).实验中,被试观看40个1 min的音乐视频,并对唤醒度、效价,喜欢/不喜欢,支配度和熟悉度进行打分. ...

... 除了脑电信号之外,融合其他生理信号有助于建立更准确的情感模型[16].这些生理信号包括眼动[49]、眼电[50]、肌电[51]、心电[32]、皮肤电[52]和呼吸[53]等. ...

基于生理信号的情感计算研究综述

4

2021

... 脑电图(electroencephalography,EEG)是情感脑机接口使用最广泛的一种生理信号[15,16,17].目前,常用的脑电采集设备有湿电极和干电极两种.从信号质量的角度来看,湿电极普遍优于干电极,但干电极的优点是佩戴方便,适合普通人使用. ...

... 具体而言,对脑电信号的处理和分析流程一般包括预处理、特征提取、特征平滑、训练分类器和测试等[5,16].由于脑电信号非常微弱,在采集过程中非常容易受到人体自身的其他生理信号以及外界环境的干扰,所以首先需要对脑电信号进行预处理,去除包括眼电伪迹、肌电伪迹、心电伪迹、皮肤电活动干扰、工频干扰等噪声与干扰. ...

... 目前,在情感脑机接口研究中使用较为广泛[16]的两个数据集分别是DEAP数据集[32]和SEED数据集[22].DEAP数据集包括32名被试的32通道的脑电数据,以及其他生理信号(眼电、肌电、皮肤电反应、呼吸、血液体积压力、皮肤温度、面部视频).实验中,被试观看40个1 min的音乐视频,并对唤醒度、效价,喜欢/不喜欢,支配度和熟悉度进行打分. ...

... 除了脑电信号之外,融合其他生理信号有助于建立更准确的情感模型[16].这些生理信号包括眼动[49]、眼电[50]、肌电[51]、心电[32]、皮肤电[52]和呼吸[53]等. ...

面向情绪识别的脑电特征研究综述

1

2019

... 脑电图(electroencephalography,EEG)是情感脑机接口使用最广泛的一种生理信号[15,16,17].目前,常用的脑电采集设备有湿电极和干电极两种.从信号质量的角度来看,湿电极普遍优于干电极,但干电极的优点是佩戴方便,适合普通人使用. ...

面向情绪识别的脑电特征研究综述

1

2019

... 脑电图(electroencephalography,EEG)是情感脑机接口使用最广泛的一种生理信号[15,16,17].目前,常用的脑电采集设备有湿电极和干电极两种.从信号质量的角度来看,湿电极普遍优于干电极,但干电极的优点是佩戴方便,适合普通人使用. ...

EEG theta power activity reflects workload among army combat drivers:an experimental study

1

2020

... 认知科学和临床医学的研究发现,脑电活动与情绪、认知密切相关.例如,脑电中的alpha频段和theta频段与脑力劳动或记忆负荷相关[18,19].类似地,临床医学的相关研究发现,静息态前额叶alpha频段脑电活动的不对称性与抑郁症程度相关[20,21].基于这些生理现象和脑电信号特征,研究者可以利用信号处理技术和深度学习算法分析脑电信号,提取与情绪和认知相关的特征,从而对人的内部状态进行检测. ...

Estimating workload using EEG spectral power and ERPs in the n-back task

1

2012

... 认知科学和临床医学的研究发现,脑电活动与情绪、认知密切相关.例如,脑电中的alpha频段和theta频段与脑力劳动或记忆负荷相关[18,19].类似地,临床医学的相关研究发现,静息态前额叶alpha频段脑电活动的不对称性与抑郁症程度相关[20,21].基于这些生理现象和脑电信号特征,研究者可以利用信号处理技术和深度学习算法分析脑电信号,提取与情绪和认知相关的特征,从而对人的内部状态进行检测. ...

Depressive symptoms and baseline prefrontal EEG alpha activity:a study utilizing ecological momentary assessment

2

2008

... 认知科学和临床医学的研究发现,脑电活动与情绪、认知密切相关.例如,脑电中的alpha频段和theta频段与脑力劳动或记忆负荷相关[18,19].类似地,临床医学的相关研究发现,静息态前额叶alpha频段脑电活动的不对称性与抑郁症程度相关[20,21].基于这些生理现象和脑电信号特征,研究者可以利用信号处理技术和深度学习算法分析脑电信号,提取与情绪和认知相关的特征,从而对人的内部状态进行检测. ...

... 由于精神障碍疾病的复杂特性,抑郁症也可能存在不同的症状组合,Putnam K M等人[20]探究了脑电与具体的抑郁症的症状的关系.作者通过高密度脑电图采样和多项自评量表方法,研究了与抑郁症相关的两个关键症状,即思维反刍(rumination)和自尊(self-esteem).分析了6名抑郁症病人和7 名健康对照组的静息态 alpha 频段脑电活动与抑郁症状的关系.症状相关量表每天收集5次,测量7 天.该研究发现,在抑郁症组中,当思维反刍症状更加明显时,双侧前额叶相关脑电活动降低;当自尊水平更高时,常伴随着较低的左侧前额叶活动.而这种对应关系在健康对照组并没有被观察到.该结果表明,抑郁症的特定症状可能与前额叶alpha脑电活动特定模式相关. ...

Frontal brain asymmetry and emotional reactivity:a biological substrate of affective style

2

1993

... 认知科学和临床医学的研究发现,脑电活动与情绪、认知密切相关.例如,脑电中的alpha频段和theta频段与脑力劳动或记忆负荷相关[18,19].类似地,临床医学的相关研究发现,静息态前额叶alpha频段脑电活动的不对称性与抑郁症程度相关[20,21].基于这些生理现象和脑电信号特征,研究者可以利用信号处理技术和深度学习算法分析脑电信号,提取与情绪和认知相关的特征,从而对人的内部状态进行检测. ...

... 许多研究表明,前额叶皮层的脑电活动与情感障碍疾病有关.1993年Wheeler R E等人[21]发现,通过静息态 alpha 频段的脑电图功率测量反映出的前额叶激活中的半球不对称性,与情感刺激的效价反应有关.进一步研究发现,这种脑电活动的非对称性是一个稳定的特征,左额叶过度激活是抑郁症的稳定标志.研究人员采用左侧电极 alpha 活动减去右侧电极 alpha 活动获得不对称性评分,发现抑郁自评越严重的被试,不对称性评分越高.这一发现引起了许多人的相继研究,有些研究发现了相同的规律,有些研究却显示两者的关系并不显著.针对这一问题,Thibodeau R 等人[82]系统地对比和总结了不同的实验条件,探究 alpha 频段的不对称性与情感类障碍(抑郁症、焦虑症、抑郁合并焦虑)的关系是否受其他因素的影响.作者发现脑电记录的时间、被试的年龄以及抑郁评价的手段都会对实验结果产生影响. ...

Investigating critical frequency bands and channels for EEG-based emotion recognition with deep neural networks

3

2015

... 值得注意的是,脑电信号是一种非稳态信号,不同个体的脑电信号有差异,即使同一个体的脑电信号也会随着时间的变化而变化.因此,利用脑电信号进行情绪识别需要回答的基本问题是,脑电信号是否存在与情绪类别相关的模式,这种模式是否广泛存在于不同个体之间,并在时间上稳定.针对此问题,研究者发现了一些有趣的跨被试的情绪模式[22].在beta和gamma频段,侧颞叶区域对于正面情绪的激活比负面情绪的激活更多.更为重要的是,在对同一被试进行3次重复实验,每次间隔1周以上的实验条件下,上述的关键频段和脑区会稳定出现.这些发现为基于脑电信号的情绪识别奠定了理论基础. ...

... 自20世纪90年代开始,医学、认知科学等领域的研究人员就在探索与情绪相关的关键脑电特征.1985年Ray W J等人[23]发表在《科学》期刊上的文章指出,在正面和负面情绪任务中,颞叶区域左右半球大脑的beta频段脑电激活强度存在差异.类似地,Ahern G L等人[24]在额叶区域观察到情绪的偏侧化激活,正面情绪时,左半球比右半球激活程度高,而负面情绪时,正好相反.近年来,随着机器学习技术的发展,研究者可以通过更有效的数据分析技术进一步研究脑电活动与情绪的关系.Zheng W L等人[22]通过分析深度信念网络的权重发现,情绪识别中颞叶和前额叶附近的通道对于情绪识别最重要,并且基于这些脑区位置的4个关键导联对3类情绪进行识别的准确率可以达到甚至超过使用全部62个通道的准确率.在频段方面,一些相关研究通过小波变换[25]、支持向量机(support vector machine,SVM)[26,27]、功能网络分析[28]等方法发现, beta和gamma等高频段与情绪识别的关系更密切. ...

... 目前,在情感脑机接口研究中使用较为广泛[16]的两个数据集分别是DEAP数据集[32]和SEED数据集[22].DEAP数据集包括32名被试的32通道的脑电数据,以及其他生理信号(眼电、肌电、皮肤电反应、呼吸、血液体积压力、皮肤温度、面部视频).实验中,被试观看40个1 min的音乐视频,并对唤醒度、效价,喜欢/不喜欢,支配度和熟悉度进行打分. ...

EEG alpha activity reflects attentional demands,and beta activity reflects emotional and cognitive processes

1

1985

... 自20世纪90年代开始,医学、认知科学等领域的研究人员就在探索与情绪相关的关键脑电特征.1985年Ray W J等人[23]发表在《科学》期刊上的文章指出,在正面和负面情绪任务中,颞叶区域左右半球大脑的beta频段脑电激活强度存在差异.类似地,Ahern G L等人[24]在额叶区域观察到情绪的偏侧化激活,正面情绪时,左半球比右半球激活程度高,而负面情绪时,正好相反.近年来,随着机器学习技术的发展,研究者可以通过更有效的数据分析技术进一步研究脑电活动与情绪的关系.Zheng W L等人[22]通过分析深度信念网络的权重发现,情绪识别中颞叶和前额叶附近的通道对于情绪识别最重要,并且基于这些脑区位置的4个关键导联对3类情绪进行识别的准确率可以达到甚至超过使用全部62个通道的准确率.在频段方面,一些相关研究通过小波变换[25]、支持向量机(support vector machine,SVM)[26,27]、功能网络分析[28]等方法发现, beta和gamma等高频段与情绪识别的关系更密切. ...

Differential lateralization for positive and negative emotion in the human brain:EEG spectral analysis

1

1985

... 自20世纪90年代开始,医学、认知科学等领域的研究人员就在探索与情绪相关的关键脑电特征.1985年Ray W J等人[23]发表在《科学》期刊上的文章指出,在正面和负面情绪任务中,颞叶区域左右半球大脑的beta频段脑电激活强度存在差异.类似地,Ahern G L等人[24]在额叶区域观察到情绪的偏侧化激活,正面情绪时,左半球比右半球激活程度高,而负面情绪时,正好相反.近年来,随着机器学习技术的发展,研究者可以通过更有效的数据分析技术进一步研究脑电活动与情绪的关系.Zheng W L等人[22]通过分析深度信念网络的权重发现,情绪识别中颞叶和前额叶附近的通道对于情绪识别最重要,并且基于这些脑区位置的4个关键导联对3类情绪进行识别的准确率可以达到甚至超过使用全部62个通道的准确率.在频段方面,一些相关研究通过小波变换[25]、支持向量机(support vector machine,SVM)[26,27]、功能网络分析[28]等方法发现, beta和gamma等高频段与情绪识别的关系更密切. ...

Wavelet-based emotion recognition system using EEG signal

1

2017

... 自20世纪90年代开始,医学、认知科学等领域的研究人员就在探索与情绪相关的关键脑电特征.1985年Ray W J等人[23]发表在《科学》期刊上的文章指出,在正面和负面情绪任务中,颞叶区域左右半球大脑的beta频段脑电激活强度存在差异.类似地,Ahern G L等人[24]在额叶区域观察到情绪的偏侧化激活,正面情绪时,左半球比右半球激活程度高,而负面情绪时,正好相反.近年来,随着机器学习技术的发展,研究者可以通过更有效的数据分析技术进一步研究脑电活动与情绪的关系.Zheng W L等人[22]通过分析深度信念网络的权重发现,情绪识别中颞叶和前额叶附近的通道对于情绪识别最重要,并且基于这些脑区位置的4个关键导联对3类情绪进行识别的准确率可以达到甚至超过使用全部62个通道的准确率.在频段方面,一些相关研究通过小波变换[25]、支持向量机(support vector machine,SVM)[26,27]、功能网络分析[28]等方法发现, beta和gamma等高频段与情绪识别的关系更密切. ...

Emotion classification using minimal EEG channels and frequency bands

1

2013

... 自20世纪90年代开始,医学、认知科学等领域的研究人员就在探索与情绪相关的关键脑电特征.1985年Ray W J等人[23]发表在《科学》期刊上的文章指出,在正面和负面情绪任务中,颞叶区域左右半球大脑的beta频段脑电激活强度存在差异.类似地,Ahern G L等人[24]在额叶区域观察到情绪的偏侧化激活,正面情绪时,左半球比右半球激活程度高,而负面情绪时,正好相反.近年来,随着机器学习技术的发展,研究者可以通过更有效的数据分析技术进一步研究脑电活动与情绪的关系.Zheng W L等人[22]通过分析深度信念网络的权重发现,情绪识别中颞叶和前额叶附近的通道对于情绪识别最重要,并且基于这些脑区位置的4个关键导联对3类情绪进行识别的准确率可以达到甚至超过使用全部62个通道的准确率.在频段方面,一些相关研究通过小波变换[25]、支持向量机(support vector machine,SVM)[26,27]、功能网络分析[28]等方法发现, beta和gamma等高频段与情绪识别的关系更密切. ...

Emotion classification based on gamma-band EEG

1

2009

... 自20世纪90年代开始,医学、认知科学等领域的研究人员就在探索与情绪相关的关键脑电特征.1985年Ray W J等人[23]发表在《科学》期刊上的文章指出,在正面和负面情绪任务中,颞叶区域左右半球大脑的beta频段脑电激活强度存在差异.类似地,Ahern G L等人[24]在额叶区域观察到情绪的偏侧化激活,正面情绪时,左半球比右半球激活程度高,而负面情绪时,正好相反.近年来,随着机器学习技术的发展,研究者可以通过更有效的数据分析技术进一步研究脑电活动与情绪的关系.Zheng W L等人[22]通过分析深度信念网络的权重发现,情绪识别中颞叶和前额叶附近的通道对于情绪识别最重要,并且基于这些脑区位置的4个关键导联对3类情绪进行识别的准确率可以达到甚至超过使用全部62个通道的准确率.在频段方面,一些相关研究通过小波变换[25]、支持向量机(support vector machine,SVM)[26,27]、功能网络分析[28]等方法发现, beta和gamma等高频段与情绪识别的关系更密切. ...

High gamma band EEG closely related to emotion:evidence from functional network

1

2020

... 自20世纪90年代开始,医学、认知科学等领域的研究人员就在探索与情绪相关的关键脑电特征.1985年Ray W J等人[23]发表在《科学》期刊上的文章指出,在正面和负面情绪任务中,颞叶区域左右半球大脑的beta频段脑电激活强度存在差异.类似地,Ahern G L等人[24]在额叶区域观察到情绪的偏侧化激活,正面情绪时,左半球比右半球激活程度高,而负面情绪时,正好相反.近年来,随着机器学习技术的发展,研究者可以通过更有效的数据分析技术进一步研究脑电活动与情绪的关系.Zheng W L等人[22]通过分析深度信念网络的权重发现,情绪识别中颞叶和前额叶附近的通道对于情绪识别最重要,并且基于这些脑区位置的4个关键导联对3类情绪进行识别的准确率可以达到甚至超过使用全部62个通道的准确率.在频段方面,一些相关研究通过小波变换[25]、支持向量机(support vector machine,SVM)[26,27]、功能网络分析[28]等方法发现, beta和gamma等高频段与情绪识别的关系更密切. ...

A dataset of continuous affect annotations and physiological signals for emotion analysis

1

2019

... 在情绪类别标注方面,目前主要采用问卷形式.具体地,一种标注方式为静态离散标注,在一段情绪刺激结束后,让被试针对情绪诱发状态填写问卷.另一种标注方式为实时连续标注,让被试对情绪刺激过程中的状态进行实时连续打分,一般被应用于效价-唤醒度的连续情绪模型[29,30,31].在情绪类别的标注准确性方面,与运动状态相比,情绪的标注往往面临的难度更大.原因是被试很难客观、准确、定量地描述自身的情绪.事实上,与情绪相关的心理学研究和临床研究的一个重要挑战就是如何找到精确、客观的情绪类别标注方法. ...

Inter-brain EEG feature extraction and analysis for continuous implicit emotion tagging during video watching

1

2018

... 在情绪类别标注方面,目前主要采用问卷形式.具体地,一种标注方式为静态离散标注,在一段情绪刺激结束后,让被试针对情绪诱发状态填写问卷.另一种标注方式为实时连续标注,让被试对情绪刺激过程中的状态进行实时连续打分,一般被应用于效价-唤醒度的连续情绪模型[29,30,31].在情绪类别的标注准确性方面,与运动状态相比,情绪的标注往往面临的难度更大.原因是被试很难客观、准确、定量地描述自身的情绪.事实上,与情绪相关的心理学研究和临床研究的一个重要挑战就是如何找到精确、客观的情绪类别标注方法. ...

Emotions promote social interaction by synchronizing brain activity across individuals

1

2012

... 在情绪类别标注方面,目前主要采用问卷形式.具体地,一种标注方式为静态离散标注,在一段情绪刺激结束后,让被试针对情绪诱发状态填写问卷.另一种标注方式为实时连续标注,让被试对情绪刺激过程中的状态进行实时连续打分,一般被应用于效价-唤醒度的连续情绪模型[29,30,31].在情绪类别的标注准确性方面,与运动状态相比,情绪的标注往往面临的难度更大.原因是被试很难客观、准确、定量地描述自身的情绪.事实上,与情绪相关的心理学研究和临床研究的一个重要挑战就是如何找到精确、客观的情绪类别标注方法. ...

DEAP:a database for emotion analysis; using physiological signals

2

2011

... 目前,在情感脑机接口研究中使用较为广泛[16]的两个数据集分别是DEAP数据集[32]和SEED数据集[22].DEAP数据集包括32名被试的32通道的脑电数据,以及其他生理信号(眼电、肌电、皮肤电反应、呼吸、血液体积压力、皮肤温度、面部视频).实验中,被试观看40个1 min的音乐视频,并对唤醒度、效价,喜欢/不喜欢,支配度和熟悉度进行打分. ...

... 除了脑电信号之外,融合其他生理信号有助于建立更准确的情感模型[16].这些生理信号包括眼动[49]、眼电[50]、肌电[51]、心电[32]、皮肤电[52]和呼吸[53]等. ...

DREAMER:a database for emotion recognition through EEG and ECG signals from wireless low-cost off-the-shelf devices

1

2017

... 此外,一些其他常用的情感脑电数据集包括DREAMER[33](23名被试的14通道脑电、心电数据)、CAS-THU[34](30名被试的14通道脑电数据)、MANHOB-HCI[35](27名被试的32通道脑电、皮肤电、心电、注视、呼吸、视频等数据)、ASCERTAIN[36] (58名被试的8通道脑电、肌电、皮肤电、面部视频数据)以及AMIGOS[37](40名被试的14通道脑电、肌电、皮肤电数据)等. ...

Real-time movie-induced discrete emotion recognition from EEG signals

1

2017

... 此外,一些其他常用的情感脑电数据集包括DREAMER[33](23名被试的14通道脑电、心电数据)、CAS-THU[34](30名被试的14通道脑电数据)、MANHOB-HCI[35](27名被试的32通道脑电、皮肤电、心电、注视、呼吸、视频等数据)、ASCERTAIN[36] (58名被试的8通道脑电、肌电、皮肤电、面部视频数据)以及AMIGOS[37](40名被试的14通道脑电、肌电、皮肤电数据)等. ...

A multimodal database for affect recognition and implicit tagging

1

2011

... 此外,一些其他常用的情感脑电数据集包括DREAMER[33](23名被试的14通道脑电、心电数据)、CAS-THU[34](30名被试的14通道脑电数据)、MANHOB-HCI[35](27名被试的32通道脑电、皮肤电、心电、注视、呼吸、视频等数据)、ASCERTAIN[36] (58名被试的8通道脑电、肌电、皮肤电、面部视频数据)以及AMIGOS[37](40名被试的14通道脑电、肌电、皮肤电数据)等. ...

Emotion and personality recognition using commercial sensors

1

2016

... 此外,一些其他常用的情感脑电数据集包括DREAMER[33](23名被试的14通道脑电、心电数据)、CAS-THU[34](30名被试的14通道脑电数据)、MANHOB-HCI[35](27名被试的32通道脑电、皮肤电、心电、注视、呼吸、视频等数据)、ASCERTAIN[36] (58名被试的8通道脑电、肌电、皮肤电、面部视频数据)以及AMIGOS[37](40名被试的14通道脑电、肌电、皮肤电数据)等. ...

AMIGOS:a dataset for affect,personality and mood research on individuals and groups

1

2018

... 此外,一些其他常用的情感脑电数据集包括DREAMER[33](23名被试的14通道脑电、心电数据)、CAS-THU[34](30名被试的14通道脑电数据)、MANHOB-HCI[35](27名被试的32通道脑电、皮肤电、心电、注视、呼吸、视频等数据)、ASCERTAIN[36] (58名被试的8通道脑电、肌电、皮肤电、面部视频数据)以及AMIGOS[37](40名被试的14通道脑电、肌电、皮肤电数据)等. ...

Improving EEG-based emotion classification using conditional transfer learning

3

2017

... 传统机器学习算法的一个重要前提假设是训练数据与测试数据必须独立同分布.当被试的脑电信号之间存在较大的个体差异时,直接采用传统的机器学习算法一般难以构建精确的跨被试情绪识别模型.针对个体差异性问题,目前的主流解决方法是通过迁移学习构建更为通用的情绪识别模型[38,39,40,41,42]. ...

... Zheng W L等人[40]研究发现,将基于直推参数迁移的迁移学习方法应用于情感脑机接口,能将3类情绪(正面、中性、负面)的识别准确率从56%提升到76%左右.类似地,Lin Y P等人[38]通过条件迁移学习模型,在情绪的效价和唤醒度预测上实现了12%~15%的性能提升. ...

... 随着深度学习的发展,基于深度网络和生成对抗网络的迁移学习也被应用于情感脑机接口,使跨被试的情绪识别性能获得了明显的提升.基于Wasserstein 距 离 的 生 成 对 抗 域 适 应 网 络(Wasserstein generative adversarial network domain adaptation,WGANDA)达到了目前 SEED 数据集上跨被试情绪识别的最高准确率87%,相较于传统的方法提升了29%左右[39].由于在脑机接口中每一个被试都是一个源域,所以常常面临源域数目过多的问题.通过多源域选择算法,可以去除与新被试差异较大的数据,实现在减少计算量的同时避免产生负迁移(negative transfer)[38,43]. ...

WGAN domain adaptation for EEG-based emotion recognition

2

2018

... 传统机器学习算法的一个重要前提假设是训练数据与测试数据必须独立同分布.当被试的脑电信号之间存在较大的个体差异时,直接采用传统的机器学习算法一般难以构建精确的跨被试情绪识别模型.针对个体差异性问题,目前的主流解决方法是通过迁移学习构建更为通用的情绪识别模型[38,39,40,41,42]. ...

... 随着深度学习的发展,基于深度网络和生成对抗网络的迁移学习也被应用于情感脑机接口,使跨被试的情绪识别性能获得了明显的提升.基于Wasserstein 距 离 的 生 成 对 抗 域 适 应 网 络(Wasserstein generative adversarial network domain adaptation,WGANDA)达到了目前 SEED 数据集上跨被试情绪识别的最高准确率87%,相较于传统的方法提升了29%左右[39].由于在脑机接口中每一个被试都是一个源域,所以常常面临源域数目过多的问题.通过多源域选择算法,可以去除与新被试差异较大的数据,实现在减少计算量的同时避免产生负迁移(negative transfer)[38,43]. ...

Personalizing EEG-based affective models with transfer learning

3

2016

... 传统机器学习算法的一个重要前提假设是训练数据与测试数据必须独立同分布.当被试的脑电信号之间存在较大的个体差异时,直接采用传统的机器学习算法一般难以构建精确的跨被试情绪识别模型.针对个体差异性问题,目前的主流解决方法是通过迁移学习构建更为通用的情绪识别模型[38,39,40,41,42]. ...

... Zheng W L等人[40]研究发现,将基于直推参数迁移的迁移学习方法应用于情感脑机接口,能将3类情绪(正面、中性、负面)的识别准确率从56%提升到76%左右.类似地,Lin Y P等人[38]通过条件迁移学习模型,在情绪的效价和唤醒度预测上实现了12%~15%的性能提升. ...

... 总体而言,基于迁移学习方法,有望建立跨被试的高性能情感模型,从而扩大情感脑机接口的适用人群范围[40,46]. ...

A review on transfer learning in EEG signal analysis

1

2020

... 传统机器学习算法的一个重要前提假设是训练数据与测试数据必须独立同分布.当被试的脑电信号之间存在较大的个体差异时,直接采用传统的机器学习算法一般难以构建精确的跨被试情绪识别模型.针对个体差异性问题,目前的主流解决方法是通过迁移学习构建更为通用的情绪识别模型[38,39,40,41,42]. ...

Transfer learning for EEG-based brain-computer interfaces:a review of progresses since 2016

1

... 传统机器学习算法的一个重要前提假设是训练数据与测试数据必须独立同分布.当被试的脑电信号之间存在较大的个体差异时,直接采用传统的机器学习算法一般难以构建精确的跨被试情绪识别模型.针对个体差异性问题,目前的主流解决方法是通过迁移学习构建更为通用的情绪识别模型[38,39,40,41,42]. ...

Multisource transfer learning for cross-subject EEG emotion recognition

1

2019

... 随着深度学习的发展,基于深度网络和生成对抗网络的迁移学习也被应用于情感脑机接口,使跨被试的情绪识别性能获得了明显的提升.基于Wasserstein 距 离 的 生 成 对 抗 域 适 应 网 络(Wasserstein generative adversarial network domain adaptation,WGANDA)达到了目前 SEED 数据集上跨被试情绪识别的最高准确率87%,相较于传统的方法提升了29%左右[39].由于在脑机接口中每一个被试都是一个源域,所以常常面临源域数目过多的问题.通过多源域选择算法,可以去除与新被试差异较大的数据,实现在减少计算量的同时避免产生负迁移(negative transfer)[38,43]. ...

Reducing the subject variability of EEG signals with adversarial domain generalization

1

2019

... 域泛化算法的优点是可以对未知的目标域数据进行高鲁棒性的预测.在无法获取新被试的数据,或者要面向很多新被试进行预测的情况下,基于域泛化算法的情感脑机接口可以获得较高的精度和较强的泛化能力[44].但是,域泛化算法由于没有使用任何目标域信息,性能往往低于域适应算法. ...

Plug-and-play domain adaptation for cross-subject EEG-based emotion recognition

1

2021

... 最近的一项研究工作尝试寻找域适应与域泛化算法之间的平衡,通过使用少量的目标域数据实现性能的提升.这种算法被称为即插即用域适应算法,能使跨被试的情感模型在 SEED 数据集上只使用45 s左右的校准数据,而获得了85%左右的准确率[45]. ...

Seizure classification from EEG signals using transfer learning,semi-supervised learning and TSK fuzzy system

1

2017

... 总体而言,基于迁移学习方法,有望建立跨被试的高性能情感模型,从而扩大情感脑机接口的适用人群范围[40,46]. ...

用异质迁移学习构建跨被试脑电情感模型

2

2020

... 在情感脑机接口的实际应用中,由于硬件条件的限制,常常会产生模态改变或缺失的情况.一方面,脑电设备价格较为昂贵,并且佩戴与调试等操作难度较高,在家庭环境中配置难度较大.这些问题导致在许多应用场景中可能缺失脑电模态,而只有眼动、视频等模态.另一方面,不同的脑电设备的通道个数和信号质量常常不同,导致训练样本与实际采集的测试数据有差异,使模型的性能大大下降.因此,建立可靠、鲁棒的情感脑机接口的一个重要挑战是如何充分考虑实际使用情况,使模型在模态改变或缺失的情况下也能达到较为令人满意的性能.针对这些问题,一些学者研究了基于异质迁移学习(heterogeneous transfer learning,HTL)的跨模态情感模型[47].异质迁移学习是针对源域和目标域的特征空间或任务空间不完全相同的场景提出的迁移学习方法[48]. ...

... 针对模态缺失的问题,在训练过程中,跨模态情感模型可以综合分析多个模态的信号,提取模态之间的关联特性.在测试阶段,基于部分模态信息进行预测.例如,建立脑电信号与眼动信号的关联,使得在脑电信号难以采集的应用场景中,可以通过异质迁移学习方法单独使用眼动信号对情绪做出评估,保证在模态缺失的情况下,评估性能的下降程度在可接受的范围内,从而提高模型的鲁棒性[47]. ...

用异质迁移学习构建跨被试脑电情感模型

2

2020

... 在情感脑机接口的实际应用中,由于硬件条件的限制,常常会产生模态改变或缺失的情况.一方面,脑电设备价格较为昂贵,并且佩戴与调试等操作难度较高,在家庭环境中配置难度较大.这些问题导致在许多应用场景中可能缺失脑电模态,而只有眼动、视频等模态.另一方面,不同的脑电设备的通道个数和信号质量常常不同,导致训练样本与实际采集的测试数据有差异,使模型的性能大大下降.因此,建立可靠、鲁棒的情感脑机接口的一个重要挑战是如何充分考虑实际使用情况,使模型在模态改变或缺失的情况下也能达到较为令人满意的性能.针对这些问题,一些学者研究了基于异质迁移学习(heterogeneous transfer learning,HTL)的跨模态情感模型[47].异质迁移学习是针对源域和目标域的特征空间或任务空间不完全相同的场景提出的迁移学习方法[48]. ...

... 针对模态缺失的问题,在训练过程中,跨模态情感模型可以综合分析多个模态的信号,提取模态之间的关联特性.在测试阶段,基于部分模态信息进行预测.例如,建立脑电信号与眼动信号的关联,使得在脑电信号难以采集的应用场景中,可以通过异质迁移学习方法单独使用眼动信号对情绪做出评估,保证在模态缺失的情况下,评估性能的下降程度在可接受的范围内,从而提高模型的鲁棒性[47]. ...

Heterogeneous transfer learning for image classification

1

2011

... 在情感脑机接口的实际应用中,由于硬件条件的限制,常常会产生模态改变或缺失的情况.一方面,脑电设备价格较为昂贵,并且佩戴与调试等操作难度较高,在家庭环境中配置难度较大.这些问题导致在许多应用场景中可能缺失脑电模态,而只有眼动、视频等模态.另一方面,不同的脑电设备的通道个数和信号质量常常不同,导致训练样本与实际采集的测试数据有差异,使模型的性能大大下降.因此,建立可靠、鲁棒的情感脑机接口的一个重要挑战是如何充分考虑实际使用情况,使模型在模态改变或缺失的情况下也能达到较为令人满意的性能.针对这些问题,一些学者研究了基于异质迁移学习(heterogeneous transfer learning,HTL)的跨模态情感模型[47].异质迁移学习是针对源域和目标域的特征空间或任务空间不完全相同的场景提出的迁移学习方法[48]. ...

Review of eye-related measures of drivers’ mental workload

3

2015

... 除了脑电信号之外,融合其他生理信号有助于建立更准确的情感模型[16].这些生理信号包括眼动[49]、眼电[50]、肌电[51]、心电[32]、皮肤电[52]和呼吸[53]等. ...

... 工作负荷通常是指任务需求与个人能力之间的比例关系[73].当任务需求接近个人能力上限时,精神负荷较大.根据心流理论(flow theory)[74],过高或过低的精神负荷均会导致注意力下降.了解人们的精神负荷情况有助于合理调节和分配工作量,从而提高工作和生产效率.在一些高压、高危环境中,需要工作人员长时间保持注意力高度集中,例如空中交通管制员[75]、飞行员[53]、驾驶员[49]等,因此对于工作负荷的检测格外重要. ...

... 为了获得实时、客观的精神负荷评估指标,研究人员探索了生理信号在精神负荷检测中的应用,包括脑电[77,78]、眼动[49]、皮肤电、心率[79]和呼吸频率[53]等.研究者比较不同生理信号的精神负荷检测结果发现,任务种类、强度和应用场景不同,生理信号的可靠性也会发生变化[80]. ...

EOG-based drowsiness detection using convolutional neural networks

1

2014

... 除了脑电信号之外,融合其他生理信号有助于建立更准确的情感模型[16].这些生理信号包括眼动[49]、眼电[50]、肌电[51]、心电[32]、皮肤电[52]和呼吸[53]等. ...

A wireless sEMG recording system and its application to muscle fatigue detection

1

2012

... 除了脑电信号之外,融合其他生理信号有助于建立更准确的情感模型[16].这些生理信号包括眼动[49]、眼电[50]、肌电[51]、心电[32]、皮肤电[52]和呼吸[53]等. ...

GSR and blink features for cognitive load classification

1

2013

... 除了脑电信号之外,融合其他生理信号有助于建立更准确的情感模型[16].这些生理信号包括眼动[49]、眼电[50]、肌电[51]、心电[32]、皮肤电[52]和呼吸[53]等. ...

Assessing pilot workload.Why measure heart rate,HRV and respiration?

3

1992

... 除了脑电信号之外,融合其他生理信号有助于建立更准确的情感模型[16].这些生理信号包括眼动[49]、眼电[50]、肌电[51]、心电[32]、皮肤电[52]和呼吸[53]等. ...

... 工作负荷通常是指任务需求与个人能力之间的比例关系[73].当任务需求接近个人能力上限时,精神负荷较大.根据心流理论(flow theory)[74],过高或过低的精神负荷均会导致注意力下降.了解人们的精神负荷情况有助于合理调节和分配工作量,从而提高工作和生产效率.在一些高压、高危环境中,需要工作人员长时间保持注意力高度集中,例如空中交通管制员[75]、飞行员[53]、驾驶员[49]等,因此对于工作负荷的检测格外重要. ...

... 工作负荷检测的研究环境大体可以分为实验室环境和真实/仿真环境.在实验室环境中,工作负荷检测的实验一般在控制身体运动和视觉输入的前提下,通过控制视觉等刺激来调控精神负荷强度.针对不同的应用场景,许多研究尝试了在仿真环境或者真实环境下的工作负荷检测.例如空中交通管制员[75,76,77,78,79,80,81]、飞行员[53]、驾驶员.值得注意的是,实验室环境与实际应用场景之间常常存在较大差距.事实上,与模拟任务相比,实际任务中相同生理信号度量值的范围往往更大.所以,如何将基于生理指标的检测标准从实验室环境有效转移到实际应用场景是该领域的一个重要挑战. ...

Continuous emotion detection using EEG signals and facial expressions

3

2014

... 此外,将脑电等生理信号与音频、视频、文本等外部行为信号进行融合,可以进一步提升多模态情感脑机接口系统的性能[54,55,56].研究结果表明,通过多模态深度学习算法提取多个模态共享的高层次特征,能够实现高效的多模态数据融合[57,58]. ...

... 一些研究工作尝试结合脑电等生理信号与视频等外部行为信号进行更为鲁棒的情绪识别[54,55,56].具体而言,Soleymani M等人[54]将基于脑电信号提取的功率谱特征与基于面部表情信号提取的基准点特征进行特征融合和决策级融合,以进行多模态的情绪识别.他们同时分析了脑电特征与面部表情特征的相关性,发现高频信号包含更多的愉悦情绪信息.类似地,Huang X H等人[56]将视频和脑电融合,基于效价-唤醒度情绪模型,建立了多模态情绪检测系统,发现两种信号的结合可以在一定程度上弥补其分别作为单一信息源的缺陷. ...

... [54]将基于脑电信号提取的功率谱特征与基于面部表情信号提取的基准点特征进行特征融合和决策级融合,以进行多模态的情绪识别.他们同时分析了脑电特征与面部表情特征的相关性,发现高频信号包含更多的愉悦情绪信息.类似地,Huang X H等人[56]将视频和脑电融合,基于效价-唤醒度情绪模型,建立了多模态情绪检测系统,发现两种信号的结合可以在一定程度上弥补其分别作为单一信息源的缺陷. ...

Fusion of facial expressions and EEG for multimodal emotion recognition

2

2017

... 此外,将脑电等生理信号与音频、视频、文本等外部行为信号进行融合,可以进一步提升多模态情感脑机接口系统的性能[54,55,56].研究结果表明,通过多模态深度学习算法提取多个模态共享的高层次特征,能够实现高效的多模态数据融合[57,58]. ...

... 一些研究工作尝试结合脑电等生理信号与视频等外部行为信号进行更为鲁棒的情绪识别[54,55,56].具体而言,Soleymani M等人[54]将基于脑电信号提取的功率谱特征与基于面部表情信号提取的基准点特征进行特征融合和决策级融合,以进行多模态的情绪识别.他们同时分析了脑电特征与面部表情特征的相关性,发现高频信号包含更多的愉悦情绪信息.类似地,Huang X H等人[56]将视频和脑电融合,基于效价-唤醒度情绪模型,建立了多模态情绪检测系统,发现两种信号的结合可以在一定程度上弥补其分别作为单一信息源的缺陷. ...

Multi-modal emotion analysis from facial expressions and electroencephalogram

3

2016

... 此外,将脑电等生理信号与音频、视频、文本等外部行为信号进行融合,可以进一步提升多模态情感脑机接口系统的性能[54,55,56].研究结果表明,通过多模态深度学习算法提取多个模态共享的高层次特征,能够实现高效的多模态数据融合[57,58]. ...

... 一些研究工作尝试结合脑电等生理信号与视频等外部行为信号进行更为鲁棒的情绪识别[54,55,56].具体而言,Soleymani M等人[54]将基于脑电信号提取的功率谱特征与基于面部表情信号提取的基准点特征进行特征融合和决策级融合,以进行多模态的情绪识别.他们同时分析了脑电特征与面部表情特征的相关性,发现高频信号包含更多的愉悦情绪信息.类似地,Huang X H等人[56]将视频和脑电融合,基于效价-唤醒度情绪模型,建立了多模态情绪检测系统,发现两种信号的结合可以在一定程度上弥补其分别作为单一信息源的缺陷. ...

... [56]将视频和脑电融合,基于效价-唤醒度情绪模型,建立了多模态情绪检测系统,发现两种信号的结合可以在一定程度上弥补其分别作为单一信息源的缺陷. ...

Multimodal emotion recognition using deep generalized canonical correlation analysis with an attention mechanism

2

2020

... 此外,将脑电等生理信号与音频、视频、文本等外部行为信号进行融合,可以进一步提升多模态情感脑机接口系统的性能[54,55,56].研究结果表明,通过多模态深度学习算法提取多个模态共享的高层次特征,能够实现高效的多模态数据融合[57,58]. ...

... 眼动信号包含瞳孔直径、注视信息和扫视信号等重要特征.脑电信号和眼动信号分别表示内部神经模式与外部潜意识行为信息,研究发现,二者在情绪识别问题中展现了很好的互补特性.对于正面情绪,脑电信号优于眼动信号;对于中性和负面情绪,眼动信号比脑电信号具有更高的识别准确率[59].将这两种信号有效地融合可以显著提高情绪识别准确率[58].进一步地,多模态数据融合不局限于脑电、眼动两种模态,通过构建注意力机制的深度泛化典则关联分析模型(DGCCA-AM)[57],可以实现任意多个模态的自适应融合,促进多模态情感脑机接口在更为复杂的场景中的应用. ...

Emotionmeter:a multimodal framework for recognizing human emotions

2

2018

... 此外,将脑电等生理信号与音频、视频、文本等外部行为信号进行融合,可以进一步提升多模态情感脑机接口系统的性能[54,55,56].研究结果表明,通过多模态深度学习算法提取多个模态共享的高层次特征,能够实现高效的多模态数据融合[57,58]. ...

... 眼动信号包含瞳孔直径、注视信息和扫视信号等重要特征.脑电信号和眼动信号分别表示内部神经模式与外部潜意识行为信息,研究发现,二者在情绪识别问题中展现了很好的互补特性.对于正面情绪,脑电信号优于眼动信号;对于中性和负面情绪,眼动信号比脑电信号具有更高的识别准确率[59].将这两种信号有效地融合可以显著提高情绪识别准确率[58].进一步地,多模态数据融合不局限于脑电、眼动两种模态,通过构建注意力机制的深度泛化典则关联分析模型(DGCCA-AM)[57],可以实现任意多个模态的自适应融合,促进多模态情感脑机接口在更为复杂的场景中的应用. ...

Combining eye movements and eeg to enhance emotion recognition

1

2015

... 眼动信号包含瞳孔直径、注视信息和扫视信号等重要特征.脑电信号和眼动信号分别表示内部神经模式与外部潜意识行为信息,研究发现,二者在情绪识别问题中展现了很好的互补特性.对于正面情绪,脑电信号优于眼动信号;对于中性和负面情绪,眼动信号比脑电信号具有更高的识别准确率[59].将这两种信号有效地融合可以显著提高情绪识别准确率[58].进一步地,多模态数据融合不局限于脑电、眼动两种模态,通过构建注意力机制的深度泛化典则关联分析模型(DGCCA-AM)[57],可以实现任意多个模态的自适应融合,促进多模态情感脑机接口在更为复杂的场景中的应用. ...

Facial expression and emotion

1

1993

... 在日常生活和交流中,人们可以通过面部表情、语音对话、肢体语言等外部行为信号对周围人的情绪进行判断.在20世纪80年代,研究者就开始探索是否存在跨文化的通用面部表情,用以表达情绪[60,61]. ...

Is there universal recognition of emotion from facial expression? A review of the cross-cultural studies

1

1994

... 在日常生活和交流中,人们可以通过面部表情、语音对话、肢体语言等外部行为信号对周围人的情绪进行判断.在20世纪80年代,研究者就开始探索是否存在跨文化的通用面部表情,用以表达情绪[60,61]. ...

Sixteen facial expressions occur in similar contexts worldwide

1

2020

... 近年来,随着计算机视觉和语音处理技术的快速发展,研究者可以使用更为丰富和有效的技术手段来分析和处理面部表情、肢体语言、声音、文本等外部行为信号,并从中识别情绪.Cowen A S等人[62]通过深度学习算法研究了来自144个国家的600万个视频.作者从这些视频中发现了面部表情与社交场景的关系,例如婚礼、体育比赛等,这种关联普遍存在于不同文化背景下.这一研究结果为基于外部行为信号的情绪识别提供了进一步的技术支撑. ...

Multimodal affective state assessment using fNIRS+ EEG and spontaneous facial expression

1

2020

... 脑电信号的一个局限性是空间分辨率比较低.相比而言,基于血氧的脑成像技术(如功能磁共振等)具有较好的空间分辨率,已被广泛用于神经影像学研究,是研究人员探究大脑活动机制的重要工具.因此,在情绪的神经机理研究中,融合脑电与各种大脑成像模态信息可以提供高分辨率的时空神经图像,有助于在产生情感状态时进一步了解大脑机制.最近的一项研究工作发现了功能性近红外光谱技术(functional near-infrared spectroscopy, fNIRS)和脑电信号之间的相关性,并且与单一模态相比,融合fNIRS和脑电信号可以达到更高的情绪识别准确率[63]. ...

Multimodal multi-channel on-line speaker diarization using sensor fusion through SVM

1

2015

... 数据层面融合[64]将不同模态的原始数据直接融合在一起.特征层面融合[65,66]提取不同模态的数据的特征,将提取的特征融合在一起.决策层面融合又叫决策级融合[67],先由每类传感器基于自己的数据做出决策,然后由融合规则给出融合结果.常见的方法包括最大值规则、求和规则、模糊积分等.但是这种融合方式很难挖掘不同模态数据的深层次互补信息. ...

Feature-level fusion approaches based on multimodal EEG data for depression recognition

1

2020

... 数据层面融合[64]将不同模态的原始数据直接融合在一起.特征层面融合[65,66]提取不同模态的数据的特征,将提取的特征融合在一起.决策层面融合又叫决策级融合[67],先由每类传感器基于自己的数据做出决策,然后由融合规则给出融合结果.常见的方法包括最大值规则、求和规则、模糊积分等.但是这种融合方式很难挖掘不同模态数据的深层次互补信息. ...

Schizophrenia diagnosis using innovative EEG feature-level fusion schemes

1

2020

... 数据层面融合[64]将不同模态的原始数据直接融合在一起.特征层面融合[65,66]提取不同模态的数据的特征,将提取的特征融合在一起.决策层面融合又叫决策级融合[67],先由每类传感器基于自己的数据做出决策,然后由融合规则给出融合结果.常见的方法包括最大值规则、求和规则、模糊积分等.但是这种融合方式很难挖掘不同模态数据的深层次互补信息. ...

Decision-level fusion of EEG and pupil features for single-trial visual detection analysis

1

2009

... 数据层面融合[64]将不同模态的原始数据直接融合在一起.特征层面融合[65,66]提取不同模态的数据的特征,将提取的特征融合在一起.决策层面融合又叫决策级融合[67],先由每类传感器基于自己的数据做出决策,然后由融合规则给出融合结果.常见的方法包括最大值规则、求和规则、模糊积分等.但是这种融合方式很难挖掘不同模态数据的深层次互补信息. ...

Multimodal emotion recognition using EEG and eye tracking data

1

2014

... 近年来深度学习的发展提供了一系列有效融合不同模态信号并提取情感特征的新方法[68,69].基于深度学习的多模态信息融合模型包括多模态深度自编码器模型[69,70]和多模态深度玻尔兹曼机模型[71].具体而言,将脑电和眼动信号的低层次特征输入多模态深度自编码器模型中,通过信号重建提取出两个模态共享的高层次特征.由于高层次特征包含了两种不同模态的信息,利用高层次的共享特征可以建立性能更好的情感模型. ...

Multimodal deep learning

2

2009

... 近年来深度学习的发展提供了一系列有效融合不同模态信号并提取情感特征的新方法[68,69].基于深度学习的多模态信息融合模型包括多模态深度自编码器模型[69,70]和多模态深度玻尔兹曼机模型[71].具体而言,将脑电和眼动信号的低层次特征输入多模态深度自编码器模型中,通过信号重建提取出两个模态共享的高层次特征.由于高层次特征包含了两种不同模态的信息,利用高层次的共享特征可以建立性能更好的情感模型. ...

... [69,70]和多模态深度玻尔兹曼机模型[71].具体而言,将脑电和眼动信号的低层次特征输入多模态深度自编码器模型中,通过信号重建提取出两个模态共享的高层次特征.由于高层次特征包含了两种不同模态的信息,利用高层次的共享特征可以建立性能更好的情感模型. ...

Multimodal emotion recognition using multimodal deep learning

1

2016

... 近年来深度学习的发展提供了一系列有效融合不同模态信号并提取情感特征的新方法[68,69].基于深度学习的多模态信息融合模型包括多模态深度自编码器模型[69,70]和多模态深度玻尔兹曼机模型[71].具体而言,将脑电和眼动信号的低层次特征输入多模态深度自编码器模型中,通过信号重建提取出两个模态共享的高层次特征.由于高层次特征包含了两种不同模态的信息,利用高层次的共享特征可以建立性能更好的情感模型. ...

Multimodal learning with deep boltzmann machines

1

2014

... 近年来深度学习的发展提供了一系列有效融合不同模态信号并提取情感特征的新方法[68,69].基于深度学习的多模态信息融合模型包括多模态深度自编码器模型[69,70]和多模态深度玻尔兹曼机模型[71].具体而言,将脑电和眼动信号的低层次特征输入多模态深度自编码器模型中,通过信号重建提取出两个模态共享的高层次特征.由于高层次特征包含了两种不同模态的信息,利用高层次的共享特征可以建立性能更好的情感模型. ...

Global,regional,and national incidence,prevalence,and years lived with disability for 328 diseases and injuries for 195 countries,1990-2016:a systematic analysis for the Global Burden of Disease Study 2016

1

2017

... 我国和全球的神经疾病和精神疾病的发病率逐年增加,给人类的健康带来重大挑战.例如,世界卫生组织指出,全球有超过2.64亿的抑郁症患者[72],每年给全球经济造成约1万亿美元的负担,是导致全球疾病负担的一个重要因素. ...

Human mental workload

1

1988

... 工作负荷通常是指任务需求与个人能力之间的比例关系[73].当任务需求接近个人能力上限时,精神负荷较大.根据心流理论(flow theory)[74],过高或过低的精神负荷均会导致注意力下降.了解人们的精神负荷情况有助于合理调节和分配工作量,从而提高工作和生产效率.在一些高压、高危环境中,需要工作人员长时间保持注意力高度集中,例如空中交通管制员[75]、飞行员[53]、驾驶员[49]等,因此对于工作负荷的检测格外重要. ...

Flow theory and research

1

2009

... 工作负荷通常是指任务需求与个人能力之间的比例关系[73].当任务需求接近个人能力上限时,精神负荷较大.根据心流理论(flow theory)[74],过高或过低的精神负荷均会导致注意力下降.了解人们的精神负荷情况有助于合理调节和分配工作量,从而提高工作和生产效率.在一些高压、高危环境中,需要工作人员长时间保持注意力高度集中,例如空中交通管制员[75]、飞行员[53]、驾驶员[49]等,因此对于工作负荷的检测格外重要. ...

Modeling and predicting mental workload in en route air traffic control:critical review and broader implications

2

2007

... 工作负荷通常是指任务需求与个人能力之间的比例关系[73].当任务需求接近个人能力上限时,精神负荷较大.根据心流理论(flow theory)[74],过高或过低的精神负荷均会导致注意力下降.了解人们的精神负荷情况有助于合理调节和分配工作量,从而提高工作和生产效率.在一些高压、高危环境中,需要工作人员长时间保持注意力高度集中,例如空中交通管制员[75]、飞行员[53]、驾驶员[49]等,因此对于工作负荷的检测格外重要. ...

... 工作负荷检测的研究环境大体可以分为实验室环境和真实/仿真环境.在实验室环境中,工作负荷检测的实验一般在控制身体运动和视觉输入的前提下,通过控制视觉等刺激来调控精神负荷强度.针对不同的应用场景,许多研究尝试了在仿真环境或者真实环境下的工作负荷检测.例如空中交通管制员[75,76,77,78,79,80,81]、飞行员[53]、驾驶员.值得注意的是,实验室环境与实际应用场景之间常常存在较大差距.事实上,与模拟任务相比,实际任务中相同生理信号度量值的范围往往更大.所以,如何将基于生理指标的检测标准从实验室环境有效转移到实际应用场景是该领域的一个重要挑战. ...

Autonomic nervous system and subjective ratings of strain in air-traffic control

2

2009

... 常用的精神负荷评估指标包括任务完成的速度和准确性.但是,这两种指标的获取常常比较滞后,一般需要在任务完成之后才能获得.这使得调控系统无法及时捕捉个人状态的变化,从而无法及时进行反馈.另外,在一些情况下,完成任务的速度和准确性比较难以量化[76]. ...

... 工作负荷检测的研究环境大体可以分为实验室环境和真实/仿真环境.在实验室环境中,工作负荷检测的实验一般在控制身体运动和视觉输入的前提下,通过控制视觉等刺激来调控精神负荷强度.针对不同的应用场景,许多研究尝试了在仿真环境或者真实环境下的工作负荷检测.例如空中交通管制员[75,76,77,78,79,80,81]、飞行员[53]、驾驶员.值得注意的是,实验室环境与实际应用场景之间常常存在较大差距.事实上,与模拟任务相比,实际任务中相同生理信号度量值的范围往往更大.所以,如何将基于生理指标的检测标准从实验室环境有效转移到实际应用场景是该领域的一个重要挑战. ...

EEG correlates of task engagement and mental workload in vigilance,learning,and memory tasks

2

2007

... 为了获得实时、客观的精神负荷评估指标,研究人员探索了生理信号在精神负荷检测中的应用,包括脑电[77,78]、眼动[49]、皮肤电、心率[79]和呼吸频率[53]等.研究者比较不同生理信号的精神负荷检测结果发现,任务种类、强度和应用场景不同,生理信号的可靠性也会发生变化[80]. ...

... 工作负荷检测的研究环境大体可以分为实验室环境和真实/仿真环境.在实验室环境中,工作负荷检测的实验一般在控制身体运动和视觉输入的前提下,通过控制视觉等刺激来调控精神负荷强度.针对不同的应用场景,许多研究尝试了在仿真环境或者真实环境下的工作负荷检测.例如空中交通管制员[75,76,77,78,79,80,81]、飞行员[53]、驾驶员.值得注意的是,实验室环境与实际应用场景之间常常存在较大差距.事实上,与模拟任务相比,实际任务中相同生理信号度量值的范围往往更大.所以,如何将基于生理指标的检测标准从实验室环境有效转移到实际应用场景是该领域的一个重要挑战. ...

Combining and comparing EEG,peripheral physiology and eye-related measures for the assessment of mental workload

2

2014

... 为了获得实时、客观的精神负荷评估指标,研究人员探索了生理信号在精神负荷检测中的应用,包括脑电[77,78]、眼动[49]、皮肤电、心率[79]和呼吸频率[53]等.研究者比较不同生理信号的精神负荷检测结果发现,任务种类、强度和应用场景不同,生理信号的可靠性也会发生变化[80]. ...

... 工作负荷检测的研究环境大体可以分为实验室环境和真实/仿真环境.在实验室环境中,工作负荷检测的实验一般在控制身体运动和视觉输入的前提下,通过控制视觉等刺激来调控精神负荷强度.针对不同的应用场景,许多研究尝试了在仿真环境或者真实环境下的工作负荷检测.例如空中交通管制员[75,76,77,78,79,80,81]、飞行员[53]、驾驶员.值得注意的是,实验室环境与实际应用场景之间常常存在较大差距.事实上,与模拟任务相比,实际任务中相同生理信号度量值的范围往往更大.所以,如何将基于生理指标的检测标准从实验室环境有效转移到实际应用场景是该领域的一个重要挑战. ...

Physiological reflections of mental workload

2

1985

... 为了获得实时、客观的精神负荷评估指标,研究人员探索了生理信号在精神负荷检测中的应用,包括脑电[77,78]、眼动[49]、皮肤电、心率[79]和呼吸频率[53]等.研究者比较不同生理信号的精神负荷检测结果发现,任务种类、强度和应用场景不同,生理信号的可靠性也会发生变化[80]. ...

... 工作负荷检测的研究环境大体可以分为实验室环境和真实/仿真环境.在实验室环境中,工作负荷检测的实验一般在控制身体运动和视觉输入的前提下,通过控制视觉等刺激来调控精神负荷强度.针对不同的应用场景,许多研究尝试了在仿真环境或者真实环境下的工作负荷检测.例如空中交通管制员[75,76,77,78,79,80,81]、飞行员[53]、驾驶员.值得注意的是,实验室环境与实际应用场景之间常常存在较大差距.事实上,与模拟任务相比,实际任务中相同生理信号度量值的范围往往更大.所以,如何将基于生理指标的检测标准从实验室环境有效转移到实际应用场景是该领域的一个重要挑战. ...

Measuring mental workload using physiological measures:a systematic review

2

2019

... 为了获得实时、客观的精神负荷评估指标,研究人员探索了生理信号在精神负荷检测中的应用,包括脑电[77,78]、眼动[49]、皮肤电、心率[79]和呼吸频率[53]等.研究者比较不同生理信号的精神负荷检测结果发现,任务种类、强度和应用场景不同,生理信号的可靠性也会发生变化[80]. ...

... 工作负荷检测的研究环境大体可以分为实验室环境和真实/仿真环境.在实验室环境中,工作负荷检测的实验一般在控制身体运动和视觉输入的前提下,通过控制视觉等刺激来调控精神负荷强度.针对不同的应用场景,许多研究尝试了在仿真环境或者真实环境下的工作负荷检测.例如空中交通管制员[75,76,77,78,79,80,81]、飞行员[53]、驾驶员.值得注意的是,实验室环境与实际应用场景之间常常存在较大差距.事实上,与模拟任务相比,实际任务中相同生理信号度量值的范围往往更大.所以,如何将基于生理指标的检测标准从实验室环境有效转移到实际应用场景是该领域的一个重要挑战. ...

Effects of mental workload on physiological and subjective responses during traffic density monitoring:a field study

1

2016

... 工作负荷检测的研究环境大体可以分为实验室环境和真实/仿真环境.在实验室环境中,工作负荷检测的实验一般在控制身体运动和视觉输入的前提下,通过控制视觉等刺激来调控精神负荷强度.针对不同的应用场景,许多研究尝试了在仿真环境或者真实环境下的工作负荷检测.例如空中交通管制员[75,76,77,78,79,80,81]、飞行员[53]、驾驶员.值得注意的是,实验室环境与实际应用场景之间常常存在较大差距.事实上,与模拟任务相比,实际任务中相同生理信号度量值的范围往往更大.所以,如何将基于生理指标的检测标准从实验室环境有效转移到实际应用场景是该领域的一个重要挑战. ...

Depression,anxiety,and resting frontal EEG asymmetry:a meta-analytic review

1

2006

... 许多研究表明,前额叶皮层的脑电活动与情感障碍疾病有关.1993年Wheeler R E等人[21]发现,通过静息态 alpha 频段的脑电图功率测量反映出的前额叶激活中的半球不对称性,与情感刺激的效价反应有关.进一步研究发现,这种脑电活动的非对称性是一个稳定的特征,左额叶过度激活是抑郁症的稳定标志.研究人员采用左侧电极 alpha 活动减去右侧电极 alpha 活动获得不对称性评分,发现抑郁自评越严重的被试,不对称性评分越高.这一发现引起了许多人的相继研究,有些研究发现了相同的规律,有些研究却显示两者的关系并不显著.针对这一问题,Thibodeau R 等人[82]系统地对比和总结了不同的实验条件,探究 alpha 频段的不对称性与情感类障碍(抑郁症、焦虑症、抑郁合并焦虑)的关系是否受其他因素的影响.作者发现脑电记录的时间、被试的年龄以及抑郁评价的手段都会对实验结果产生影响. ...

EEG resting-state large-scale brain network dynamics are related to depressive symptoms

1

2019

... 除了脑电的不对称性特征之外,一些研究探索了其他脑电特征与情感障碍的关系.Damborská A等人[83]对 19 名不同程度的抑郁症病人(患者组)和19名健康对照组的静息态脑电微状态进行分析,通过聚类发现6种脑电微状态(A~F),在患者组中,发现蒙哥马利-艾森贝格抑郁评定量表的抑郁症状较高,且与微状态A的发生呈现相关关系.该实验结果显示,静息态的脑电微状态参数可以在一定程度上反映与抑郁症状相关的大规模脑网络动态变化.Cai H S 等人[84]采用基于案例推理(case-based reasoning,CBR)的机器学习算法分析脑电数据辅助抑郁情绪的检测. ...

A case-based reasoning model for depression based on three-electrode EEG data

1

2018

... 除了脑电的不对称性特征之外,一些研究探索了其他脑电特征与情感障碍的关系.Damborská A等人[83]对 19 名不同程度的抑郁症病人(患者组)和19名健康对照组的静息态脑电微状态进行分析,通过聚类发现6种脑电微状态(A~F),在患者组中,发现蒙哥马利-艾森贝格抑郁评定量表的抑郁症状较高,且与微状态A的发生呈现相关关系.该实验结果显示,静息态的脑电微状态参数可以在一定程度上反映与抑郁症状相关的大规模脑网络动态变化.Cai H S 等人[84]采用基于案例推理(case-based reasoning,CBR)的机器学习算法分析脑电数据辅助抑郁情绪的检测. ...

Identification of psychiatric disorder subtypes from functional connectivity patterns in resting-state electroencephalography

2020

The Hamilton rating scale for depression

1

1986

... 根据上述设计目标,本文探讨了如何将目前普遍使用的抑郁量表中的条目转化为客观的交互实验.常见的量表可以分为3类:通用的检查量表、通用的自评量表和用于特殊人群或特殊目的的抑郁量表.具体的常用量表包括:汉密尔顿抑郁量表[86]、Montgomerty-Asberg抑郁量表[87]等检测量表,流调用抑郁自评量表[88]、抑郁自评量表[89]、贝克忧郁量表[90]、9项患者健康问卷[91]等自评量表,以及医院焦虑抑郁量表[92]和纽卡斯尔抑郁诊断量表[93]这两个特殊类型的量表.上述量表大部分是对睡眠状态、情绪、注意力、反应时间、身体和精神状态及兴趣、动力等因素进行测试的. ...

A new depression scale designed to be sensitive to change

1

1979

... 根据上述设计目标,本文探讨了如何将目前普遍使用的抑郁量表中的条目转化为客观的交互实验.常见的量表可以分为3类:通用的检查量表、通用的自评量表和用于特殊人群或特殊目的的抑郁量表.具体的常用量表包括:汉密尔顿抑郁量表[86]、Montgomerty-Asberg抑郁量表[87]等检测量表,流调用抑郁自评量表[88]、抑郁自评量表[89]、贝克忧郁量表[90]、9项患者健康问卷[91]等自评量表,以及医院焦虑抑郁量表[92]和纽卡斯尔抑郁诊断量表[93]这两个特殊类型的量表.上述量表大部分是对睡眠状态、情绪、注意力、反应时间、身体和精神状态及兴趣、动力等因素进行测试的. ...

Two shorter forms of the CES-D depression symptoms index

1

1993

... 根据上述设计目标,本文探讨了如何将目前普遍使用的抑郁量表中的条目转化为客观的交互实验.常见的量表可以分为3类:通用的检查量表、通用的自评量表和用于特殊人群或特殊目的的抑郁量表.具体的常用量表包括:汉密尔顿抑郁量表[86]、Montgomerty-Asberg抑郁量表[87]等检测量表,流调用抑郁自评量表[88]、抑郁自评量表[89]、贝克忧郁量表[90]、9项患者健康问卷[91]等自评量表,以及医院焦虑抑郁量表[92]和纽卡斯尔抑郁诊断量表[93]这两个特殊类型的量表.上述量表大部分是对睡眠状态、情绪、注意力、反应时间、身体和精神状态及兴趣、动力等因素进行测试的. ...

A self-rating depression scale

1

1965

... 根据上述设计目标,本文探讨了如何将目前普遍使用的抑郁量表中的条目转化为客观的交互实验.常见的量表可以分为3类:通用的检查量表、通用的自评量表和用于特殊人群或特殊目的的抑郁量表.具体的常用量表包括:汉密尔顿抑郁量表[86]、Montgomerty-Asberg抑郁量表[87]等检测量表,流调用抑郁自评量表[88]、抑郁自评量表[89]、贝克忧郁量表[90]、9项患者健康问卷[91]等自评量表,以及医院焦虑抑郁量表[92]和纽卡斯尔抑郁诊断量表[93]这两个特殊类型的量表.上述量表大部分是对睡眠状态、情绪、注意力、反应时间、身体和精神状态及兴趣、动力等因素进行测试的. ...

Screening depressed patients in family practice:a rapid technic

1

1972

... 根据上述设计目标,本文探讨了如何将目前普遍使用的抑郁量表中的条目转化为客观的交互实验.常见的量表可以分为3类:通用的检查量表、通用的自评量表和用于特殊人群或特殊目的的抑郁量表.具体的常用量表包括:汉密尔顿抑郁量表[86]、Montgomerty-Asberg抑郁量表[87]等检测量表,流调用抑郁自评量表[88]、抑郁自评量表[89]、贝克忧郁量表[90]、9项患者健康问卷[91]等自评量表,以及医院焦虑抑郁量表[92]和纽卡斯尔抑郁诊断量表[93]这两个特殊类型的量表.上述量表大部分是对睡眠状态、情绪、注意力、反应时间、身体和精神状态及兴趣、动力等因素进行测试的. ...

The PHQ‐9:validity of a brief depression severity measure

1

2001

... 根据上述设计目标,本文探讨了如何将目前普遍使用的抑郁量表中的条目转化为客观的交互实验.常见的量表可以分为3类:通用的检查量表、通用的自评量表和用于特殊人群或特殊目的的抑郁量表.具体的常用量表包括:汉密尔顿抑郁量表[86]、Montgomerty-Asberg抑郁量表[87]等检测量表,流调用抑郁自评量表[88]、抑郁自评量表[89]、贝克忧郁量表[90]、9项患者健康问卷[91]等自评量表,以及医院焦虑抑郁量表[92]和纽卡斯尔抑郁诊断量表[93]这两个特殊类型的量表.上述量表大部分是对睡眠状态、情绪、注意力、反应时间、身体和精神状态及兴趣、动力等因素进行测试的. ...

The hospital anxiety and depression scale

1

1983

... 根据上述设计目标,本文探讨了如何将目前普遍使用的抑郁量表中的条目转化为客观的交互实验.常见的量表可以分为3类:通用的检查量表、通用的自评量表和用于特殊人群或特殊目的的抑郁量表.具体的常用量表包括:汉密尔顿抑郁量表[86]、Montgomerty-Asberg抑郁量表[87]等检测量表,流调用抑郁自评量表[88]、抑郁自评量表[89]、贝克忧郁量表[90]、9项患者健康问卷[91]等自评量表,以及医院焦虑抑郁量表[92]和纽卡斯尔抑郁诊断量表[93]这两个特殊类型的量表.上述量表大部分是对睡眠状态、情绪、注意力、反应时间、身体和精神状态及兴趣、动力等因素进行测试的. ...

Depression and the newcastle scales their relationship to Hamilton’s scale

1

1972

... 根据上述设计目标,本文探讨了如何将目前普遍使用的抑郁量表中的条目转化为客观的交互实验.常见的量表可以分为3类:通用的检查量表、通用的自评量表和用于特殊人群或特殊目的的抑郁量表.具体的常用量表包括:汉密尔顿抑郁量表[86]、Montgomerty-Asberg抑郁量表[87]等检测量表,流调用抑郁自评量表[88]、抑郁自评量表[89]、贝克忧郁量表[90]、9项患者健康问卷[91]等自评量表,以及医院焦虑抑郁量表[92]和纽卡斯尔抑郁诊断量表[93]这两个特殊类型的量表.上述量表大部分是对睡眠状态、情绪、注意力、反应时间、身体和精神状态及兴趣、动力等因素进行测试的. ...

Deep brain stimulation

1

2006

... 情绪调控脑机接口在对人的情绪进行解码之后,能够实现有效的情绪调控.在情感障碍疾病的诊治中,人们希望借助多模态情感脑机接口对患者的抑郁状态进行评估,并在恰当时刻进行神经调控.在侵入式神经调控系统中,借助脑深部电刺激(deep brain stimulation,DBS)技术[94,95]可以对相应脑区进行刺激,实现情绪的调节. ...

Long-term follow-up of bilateral subthalamic deep brain stimulation for refractory tardive dystonia

1

2017

... 情绪调控脑机接口在对人的情绪进行解码之后,能够实现有效的情绪调控.在情感障碍疾病的诊治中,人们希望借助多模态情感脑机接口对患者的抑郁状态进行评估,并在恰当时刻进行神经调控.在侵入式神经调控系统中,借助脑深部电刺激(deep brain stimulation,DBS)技术[94,95]可以对相应脑区进行刺激,实现情绪的调节. ...

Modelling and prediction of the dynamic responses of large-scale brain networks during direct electrical stimulation

1

2021

... 由于精神障碍在每个患者的大脑中的表现不同,个性化的脑深度刺激存在很多挑战.每个患者的大脑活动和症状对刺激的反应可能非常不同,这使得研究者很难知道刺激对特定患者的效果和影响.来自南加州大学的Shanechi团队开发了一种新方法[96],通过开发动态输入输出模型来预测大脑多个脑区对刺激模式变化的反应.他们发现大脑网络活动受刺激的幅值和频率的调控,预测刺激的实时动态效果可以帮助研究者设计更加精确的闭环神经调控系统. ...

State- dependent responses to intracranial brain stimulation in a patient with depression

1

2021

... 另外,来自加州大学旧金山分校的Scangos K W团队发现了轻度刺激对患有严重抗药性抑郁症患者的几个与情绪相关的大脑脑区的作用[97].他们发现,对几个不同大脑脑区进行90 s的刺激,可以可靠地产生积极情绪,不同程度地改善患者症状,具体情况依赖于患者在刺激时的精神状态.对眶额叶皮质(orbitofrontal cortex)的刺激可以改善患者的情绪[98].这些工作为下一步重大临床试验奠定了基础. ...

Direct electrical stimulation of lateral orbitofrontal cortex acutely improves mood in individuals with symptoms of depression

1

2018

... 另外,来自加州大学旧金山分校的Scangos K W团队发现了轻度刺激对患有严重抗药性抑郁症患者的几个与情绪相关的大脑脑区的作用[97].他们发现,对几个不同大脑脑区进行90 s的刺激,可以可靠地产生积极情绪,不同程度地改善患者症状,具体情况依赖于患者在刺激时的精神状态.对眶额叶皮质(orbitofrontal cortex)的刺激可以改善患者的情绪[98].这些工作为下一步重大临床试验奠定了基础. ...