1 引言

近年来,飞行时间(time-of-flight,ToF)相机由于具有低成本、高精度、高可靠性和高帧率等优点[1 ] ,越来越受到人们的关注。ToF 相机通过计算发射红外信号与反射信号间的相位差,得到三维深度信息[2 ] 。基于以上特点,ToF 相机可以应用在很多场景,如机器人视觉[3 ] 、三维重建[4 ] 、娱乐交互[5 ] 、及时定位与地图构建(SLAM)[6 ] 等。

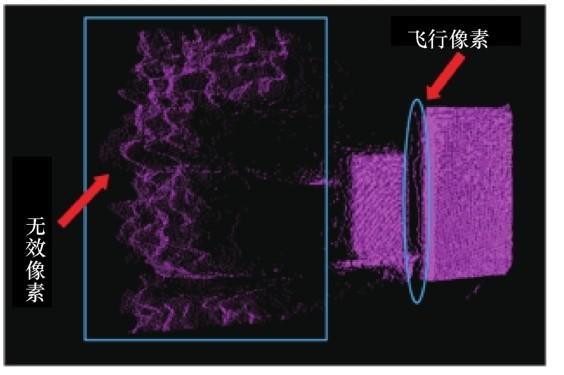

然而,对于目前的ToF相机来说,飞行像素效应带来的深度估计误差是无法避免的,这给ToF相机的应用带来了巨大挑战[7 ] 。因为ToF传感器的像素有一定的物理尺寸,所以每一个像素都可以接收到某一小块场景对应的距离信息。如果其中一块场景包含了物体边缘,那么深度量测值则是由不同距离的物体共同作用的。因此,飞行像素出现在不同深度物体的边缘处,如图1 所示。

图1

在过去几年中,人们在飞行像素校正方面做了很多研究。Sabov 等人[8 ] 采用固定深度阈值(fixed depth threshold,FDT)和线性分割的方法对飞行像素进行识别和校正。Zhang 等人[9 ] 通过设置浮动深度阈值(adaptive depth threshold,ADT)去除飞行像素,但对无效像素的滤除能力有限。在参考文献[10 ]中,一种自适应幅度阈值(adaptive amplitude threshold,AAT)方法被用于剔除错误像素,同时能够校正距离解析错误的低置信度像素。Mutto等人[11 ] 利用双目RGB测得的深度数据,对ToF传感器所测置信度图中较低部分的深度值进行了校正,可以有效解决无效像素的问题,但这种方法需要借助于其他测距设备。

当ToF投射器发出的红外光经反射后变得较弱时,ToF传感器接收到的信号幅度也随之变弱,从而造成信噪比下降。这种情况下,深度值可能会出现虚假边缘。在具体场景中表现为:ToF传感器中对应于低反射率物体的相邻2个像素产生的深度值会像边缘处一样剧烈变化,这一特性与飞行像素和低置信度的错误像素的表现类似。由于上述像素和低置信度的错误像素并没有提供有价值的场景信息,有时甚至会对场景理解造成障碍,因此称之为无效像素。在图1 中,椭圆和矩形框中标出的像素分别为飞行像素和无效像素。由于它们特征相似,因此有效地将其进行区分变得比较困难。

通过利用深度图和置信度图,提出一种基于ToF相机的有效深度数据提取的方法。在解决上述问题时,默认ToF相机已完成标定[12 ] 。一方面,为了区分有效像素和无效像素,首先使用基于核密度估计和连通域标记(connected component labeling, CCL)的自适应深度图像分割方法,将深度图分割为多个像素块,然后将一种改进的结构张量作为边缘检测器,最后利用投票操作决定每个像素块是被校正还是被剔除,从而得到深度图。另一方面,通过计算增强置信度,剔除那些不能提供足够置信度的像素,得到另外一幅深度图。最后计算2幅深度图的有效像素的交集,从而得到最终的深度数据。

2 深度数据的提取与校正算法

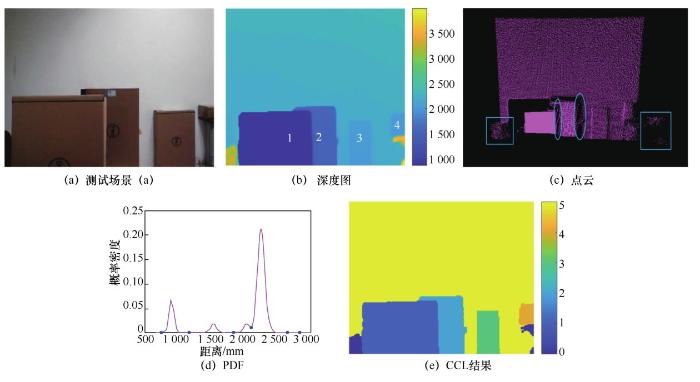

通过计算ToF正弦回波信号与参考正弦信号的相位差,可以分别得到深度图和置信度图[7 ] ,具体的算法流程如图2 所示。该算法以测试场景(a)和测试场景(b)为例进行阐述。

图2

2.1 深度图分割

图3 为测试场景(a)的深度图处理过程。测试场景(a)如图3 (a)所示,4个方纸盒分别放置于距ToF相机不同距离处,最远处白墙与ToF相机的距离为2.2 m。图3 (b)为中值滤波后的深度图(深度值在右侧标出,单位为m)。在给定内参的条件下,可将二维深度图转换成三维点云,结果如图3 (c)所示,由椭圆和矩形框标识出的像素分别为飞行像素和无效像素。首先,应用基于核密度估计的图像分割方法[13 ] 将深度图按距离分割为多个像素块。核密度估计是一种用于估计随机变量概率密度函数的无参数估计方法。若给定核K(·)和带宽h,核密度估计可以表示为:

p ^ ( q ) = 1 N h ∑ i = 1 N K ( | | q − q i | | h ) ( 1 )

其中,qi 为第 i 个数据点,N 为数据点的总数。对于每一个点q,p ^ ( q ) = 1 N h ∑ i = 1 N K ( | | q − q i | | h ) ( 1 ) i 为中心的核的均值,h为平滑参数并且为正数。

在本文所提算法中,使用基于二维高斯核的核密度估计来计算深度图像的概率密度函数,令参数h=15。图3 (d)描述了测试场景(a)的深度图的概率密度函数(probability density function,PDF)。可以求出概率密度函数的局部极小值Di ,将其作为深度分割的边界值,定义D 1 < D 2 < · · · < D w min 和Dmax 分别表示深度图中距离的最小值和最大值,那么深度分割的边界可以表示为D = { D m i n , D 1 , … , D w , D m a x }

B k ( x , y ) = { 1 , 0 , D k ≤ Z ( x , y ) ≤ D k + 1 其 他 ( 2 )

其中,k = 0 , 1 , 2 , … , w , Z ( x , y ) k (x,y)的深度值标记为1,其他像素标记为0。

2.2 连通域标记

深度图像被分割后,应用一次扫描连通域标记算法处理每个距离段的像素块[14 ] 。扫描顺序为从左到右、从上到下,初始化新的标签值 l=2。一次扫描连通域标记算法的步骤如下:

• 扫描二值图像,若发现未标记的目标像素,则将其赋予新的标签l;

• 递归地将标签l 赋予其八邻域中未标记的目标像素,直到没有未标记的目标像素;

假设在深度区间[Dk ,Dk+1 ]内有L个连通域,将每个连通域B k l n k l H 图3 (e)为连通域标记的结果。

2.3 边缘检测

边缘检测用于尽可能多地识别无效像素和飞行像素,它决定了有效深度数据提取的性能。由于结构张量对噪声的鲁棒性较好,因此将其作为边缘检测器[15 ] 。初始矩阵由深度图像I J 0

J 0 = ∇ I ( ∇ I ) T = [ I x 2 I x I y I x I y I y 2 ] ( 3 )

其中,∇ I = [ I x , I y ] I x I y

J σ = R σ * ( ∇ I ∇ I T ) = [ ∑ r R σ I x 2 ∑ r R σ I x I y ∑ r R σ I x I y ∑ r R σ I y 2 ] ( 4 )

其中,“*”表示卷积。Rσ 一般为高斯函数,用来对结构张量进行平滑处理。虽然高斯函数对噪声的 鲁棒性较好,但是它可能使边缘模糊。不同于常用的高斯函数,采用双边核对结构张量进行平滑处理,可以保持边缘信息,尽量避免边缘模糊。另外,也可以考虑将局部邻域幅度信息作为权重函数的一个因子。这里将拉普拉斯核加入权重函数中,那么混合加权核函数可以表示为:

图3

K b , σ d , σ r = A F b * B F σ d , σ r ( 5 )

其中,B F σ d , σ r b 为幅度滤波器,其 计算式如下:

A F b = 1 W A F e − | A p − A q | b ( 6 )

其中,A为幅度图,p为 当前待处理像素,q位于 像素 p 的邻域 N(p),即 q∈N(p),b 表示权重带宽, W A F = Σ q ∈ N ( p ) e x p ( − | A p − A q | / b )

从改进的结构张量矩阵 J σ t r ( J σ ) r a n k ( J σ ) t r ( J σ ) = 0 t r ( J σ ) > 0 t r ( J σ ) = 0 t r ( J σ ) > 0 r a n k ( J σ ) > 0 E 图4 (e)所示。

图4

图4 对比了常用的 边缘检测方 法。由图4 可 以看出,本文提出的边缘检测方法能够准确地检测到图像中大部分的边缘信息和无效像素。图4 (a)为Roberts算子提取的边缘结果,该算子对噪声非常敏感;图4 (b)展示了LOG算子的结果,该算子引入了大量的虚假边缘;如图4 (c)所示,虽然Canny算子可以将所有边缘检测出来,但是对于图像左下角和右下角的无效像素的检测,性能 显然还不够理想;图4 (d)中的常用结构张量在探测虚假边缘时会出现边缘不连续及虚假边缘的情况,图中方框放大了边缘细节。

2.4 投票操作

经过边缘检测 ,有用的边缘信息和无效像素都存于边缘图像中,可根据投票决定对这些像素进行校正或剔除。将同时出现在边缘图像 E B k l m k l

m k l = ∑ ( x , y ) ∈ Z B k l ( x , y ) ∘ E ( x , y ) ( 7 )

其中,“○”表示哈达玛积, 即两矩阵相 同位置像素相乘。

记录无效像素的图像Ê m k l B k l

E ^ = { Z ( x , y ) | m k l n k l > T , ( x , y ) ∈ B } k l ( 8 )

设置比例阈值为T,若边缘像素数量m k l B k l E V 1

V 1 = Z − ( E ^ ∪ H ) ( 9 )

通过投票操作,可将飞行 像素和无效 像素区分开。如图5 所示,白色像素为待校正的飞行像素,橙色像素为需删除的无效像素。飞行像素的深度值可以用双三次方插值算法进行校正[16 ] 。

图5

2.5 增强置信度

虽然大部分的无效像素都 可被上述算 法识别,但是当物体间距离较近时,错误像素可能会出现在间隙处,从而妨碍图像的后续处理。

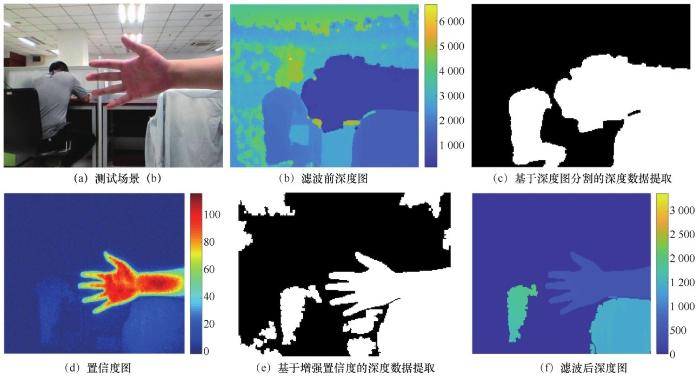

测试场景(b)如图6 (a)所示,包括一只手、一个被外套盖住的椅子和一个坐着人的椅子。然而,如图6 (b)所示(深度值在右侧标出,单位为mm),在滤波前的原始深度图中,手指间存在很多错误像素,手掌完全无法被识别。如图6 (c)所示,即使利用基于图像分割的有效深度数据提取方法,手掌的形状依然无法被识别。因此,进一步利用置信度图V 1 = Z − ( E ^ ∪ H ) ( 9 ) C = | A 0 − A 2 | + | A 1 − A 3 | A i ( i = 0 , 1 , 2 , 3 ) 图6 (d)可以看出,手指间和背景的置信度明显低于手掌和手臂部分的置信度,即错误像素的置信度明显低于同距离处手掌和手臂的有效像素。利用这个特点,增强置信度可以构建为:

A C ( x , y ) = C ( x , y ) ⋅ [ Z ( x , y ) ⋅

( ( x − c x ) / f x ) 2 + ( ( y − c y ) / f y ) 2 + 1 ] 2 ( 10 )

其中,(cx ,cy )为To F传感器的光学中心,fx 、fy 分别为相机沿x轴和y轴的焦距。

2.6 错误像素剔除

得到增强置信度图像后,通过设置一个阈值来区分错误像素和有效像素。这样可以得到另一幅记录有效像素的深度图像 V 2 图6 (e)所示,手从背景中很好地分离了出来,由于人的头发与裤子均为黑色,其较低的反射率造成对应像素的置信度低,从而被剔除。最终的深度图像可由V 1 V 2 图6 (f)所示(深度值在右侧标出,单位为mm)。从图6 (f)可以看出,背景中大部分的无效像素都被滤除了,手、身体和被外套覆盖的椅子的深度信息均得到保留。

3 实验结果

为了评估本文所提算法性能,使用已标定好的索尼IMX316 ToF相机进行拍照测试。投射器发出的红外光线波长为940 nm,相机每个周期采样4幅强度图像,分辨率为240×180。从这4幅图像可以进一步得到置信度图像、幅度图像和深度图像。出于人眼的安全保护需要,投射器功率被限制,相机的最远工作距离被控制为5 m。

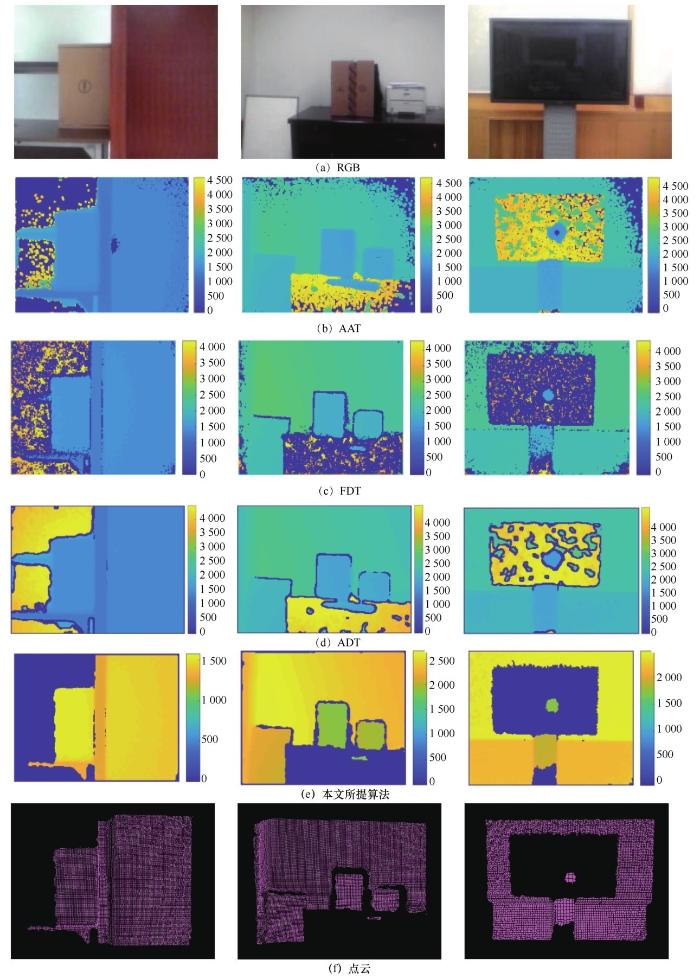

图7 为场景I、场景II、场景III对应的RGB图像。场景I中的毛玻璃、场景II中办公桌的下方和场景III中的电视屏幕的反射率均较低,使用ToF相机测量得到的深度值剧烈波动,RMSE值均在100 mm以上,因此这些像素被判为无效数据并被剔除。

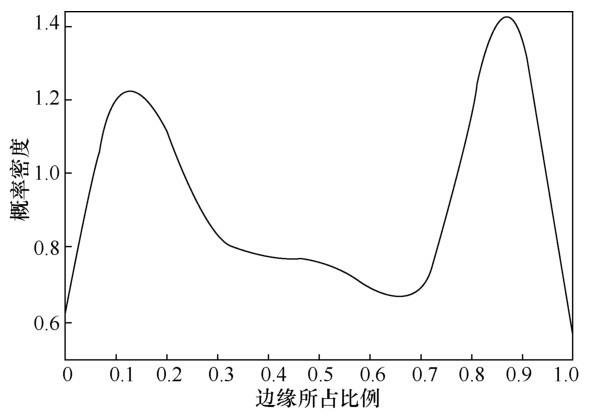

首先针对阈值T的选择进行分析,用核密度估计对探测的边缘占所在分割块比例进行拟合,统计结果如图8 所示。一般情况下,飞行像素占所在分割块比例较低,而无效像素占所在分割块比例较高。根据图8 中的拟合曲线可以得出,将阈值T设置为0.7时,其分割能力最好,基本可以将无效像素和飞行像素区分开。

图6

图7

图8

然后将FDT、AAT和ADT与本文所提算法进行性能对比,如图9 所示(深度值在右侧标出,单位为m m)。A AT中的参数bwp 为置信度,由幅度计算得到[10 ] ,置信度与幅度之间只是常系数的差别,因此可以认为两者等价。文中bwp 为对距离To F相机1 m处白墙测距得到的置信度。AAT在处理周期缠绕错误时,表现通常很好,但是当其被应用于低反射率物体时,无法很好地识别有效深度数据,并且会引入许多噪声,如图9 (b)所示。尽管FDT在识别边缘方面性能更好,但是它无法区分有效像素和飞行像素,并且漏掉了大量无效像素,同时还引入了少量噪声。如图9 (c)所示,FDT对图像4个角落的噪声的鲁棒性较差。从图9 (d)可以看出ADT能够很好地识别飞行像素,并且在有效像素区域几乎不引入噪声,因此ADT对飞行像素的处理效果在几个对比算法中表现最好,但是对于无效像素的识别,ADT几乎没有起任何作用。与之相比,本文所提算法可以识别和校正大部分无效像素和飞行像素,同时引入非常少量的噪声,如图9 (e)所示。为了更直观地观察深度图效果,利用标定好的内参,可以将图9 (e)中的深度图转换为点云图,如图9 (f)所示。

接下来对几种算法进行量化分析。由于 Sony SDK同样可生成最终深度图,且根据数据手册,测距精度小于1%,可通过其对同一场景测量的15帧深度图做平均,并将结果作为基准图像。然后基于互信息,分别用上述几种算法生成的深度图与其进行图像相似度度量[17 ] ,并进行比较。本次共对30个不同的室内场景进行测量,计算其与由 Sony 生成的深度图的相似度,并取平均值,结果见表1 。

从表1 中可以看到,量化结果与之前主观观察判断的结果一致,本文提出的算法生成的深度图与Sony的相似度最高,其次为ADT和FDT,AAT效果较差,几乎无法应对无效像素。

4 结束语

本文提出了一种基于 ToF 相机的有效深度数据提取的算法,利用深度图像和置信度图像,在剔除无效像素的同时,可以校正飞行像素的深度值。首先应用基于核密度估计的图像分割方法和连通域标记进行深度图像的自适应分割;然后通过改进权重核函数,使用改进的结构张量进行边缘检测;最后利用投票操作剔除无效像素,或者对飞行像素进行双三次方插值校正。与此同时,通过计算增强置信度来移除低置信度的错误像素。最终的深度数据由之前2幅深度图像相交得到。

实验结果证明了本文所提算法的有效性。相比于传统方法,本文所提算法可以剔除更多的无效像素,且保留更多的有效深度数据,同时,对于噪声的鲁棒性也更好。但是,目前深度图像还缺少地面真实值。在接下来的工作中,需要在构建具有地面真实值的场景数据库方面投入更多精力,从而进一步检测本文所提算法的性能。

图9

The authors have declared that no competing interests exist.

作者已声明无竞争性利益关系。

参考文献

View Option

[1]

HE Y , CHE N S . Recent advancees in 3D data acquiisition and processin ng by time-of-fliight camera

[J]. IEEE Access , 2019 ,7 : 112495 -12510 .

[本文引用: 1]

[2]

HAASE J F , BEER M , RUSKOWSKI J ,et al . Multi object detectio on in direct time-of-flight measurrements with SPADs

[C]// IEEE 20 18 14th Confereence on Ph.D.Reseearch in Microelecttronics and Electro onics(PRIME) . Piscataway:IEEE Press , 2018 : 237 -2239 .

[本文引用: 1]

[3]

PINTO A M , COSTA P , MOREIRA A P ,et al . Evaluation of deppth sensors for rrobotic application ns

[C]// 2015 IEEE International Conf ference on Auttonomous Robot Systems and Comppetitions . Piscatawaay:IEEE Press , 2201 5 : 139 -143 .

[本文引用: 1]

[4]

NGUYEN T , HUYNH H , MEUNIER J . 3D reconstruction wi ith time-of-flighht depth camera an nd multiple mirroors

[J]. IEEE Acces ss , 2018 ,6 : 381006 -38114 .

[本文引用: 1]

[5]

INOUE Y , NISHIDE S , REN F J . Facial expression recognition ada aptive to face ppose using RGB-D camera

[C]// 2019 International Confference on Indu ustrial,Engineering g and Other Appliccations Applied Inteelligent Systems . Heidelberg:Sprringer , 2016 : 422 -427 .

[本文引用: 1]

[6]

SCHÖNLIEB A , HANNES P , STEGER C ,et al . Hybrid Sensinng approach forr coded modulation n Time-of-Flight ccameras

[C]// Desig gn,Automation & Test in Europe Conference & Exhhibition(DATE) . Pi iscataway:IE EE Press , 2019 : 1076 -1081 .

[本文引用: 1]

[7]

ZANUTTIGH P , MARIN G , MUTTO C D ,et al . Time-of-flight annd structured ligght depth cameras

[M]. Heidelberg : SppringerPress , 2016 .

[本文引用: 2]

[8]

SABOV A , KRÜGER J , . Identiification and correc ction of flying pixe els in range camera data

[C]// The 24th Spring Confference on Comput ter Graphics . Ne ew York:ACM Presss , 2008 : 135 -142 .

[本文引用: 1]

[9]

ZHANG H , RONG X , LI Y ,et al . Calibration aand gray-level imag ge generation ffoor the SR4500 TooF camera

[J]. Interrnational Journal of Control and Automation , 2016 ,9 (6 ): 277 -288 .

[本文引用: 1]

[10]

JANN P , BI RK A . A novel ap pproach to efficien tt error correction f for the Swiss Raanger time-of-flightt 3D camera

[C]// RoboCup 2008:Rob bot Soccer Worldd Cup XII . Heidelberg:Springer , 2008 ,8 : 247 -258 .

[本文引用: 2]

[11]

MUTTO C D , ZANUTTIGH P , CORTELAZZ O G M . Probabilist tic ToF and ster eo data fusion baseed on mixed pixelss measurement mo odels

[J]. IEEE Transactions on Pattern Analysis aand Machine Intellligence , 2015 ,37 (11 ): 2260 -2272

[本文引用: 1]

[12]

ZHANG Z Y . A flexible new tec chnique for cameraa calibration

[J]. IEEE Transactions on Pattern Analysis and Maachine Intelligenc ce , 2000 ,22 (11 ): 1330 -1334 .

[本文引用: 1]

[13]

PARVIZI E , WU Q M J . Multtiple object trackinng based on adaptiv ve depth segmenntation

[C]// 2008 Canadian Conferennce on Computer an nd Robot Visionn . Piscataway:IEEE Press , 2008 : 273 -277 .

[本文引用: 1]

[14]

RUBIO D O , LENSKIY A , RYU J . Connected co omponents for a fa ast and robust 2D LiDAR data seggmentation

[C]// Thee 7th Asia Modellin ng Symposium . Piscataway:IEEE Press , 2013 : 160 -165 .

[本文引用: 1]

[15]

FÖRSTNER W , GÜLCH E , . A fast operator for d detection and preci ise location of d istinct points,cornners and centers of circular features

[C]// Proceedings of ISPRS Inter r Commission Conference on Fa ast Processing off Photogrammetric Data.[S.l.:s.n] . 1998 : 281 -305 .

[本文引用: 1]

[16]

ZHONG Y T , WANG Y , PIAO Y . Depth image interpolation n algorithm base ed on confidence map

[C]// Chinese Society for Optical l Engineering Conference.[S.l.:s.n] . 2017 :102550D.

[本文引用: 1]

[17]

VIOLA P , WELLS W . Alignment by max ximization of mutuual informationn

[J]. International Journal of Computer Vision , 1997 ,24 (2 ): 137 -154 .

[本文引用: 1]

Recent advancees in 3D data acquiisition and processin ng by time-of-fliight camera

1

2019

... 近年来,飞行时间(time-of-flight,ToF)相机由于具有低成本、高精度、高可靠性和高帧率等优点[1 ] ,越来越受到人们的关注.ToF 相机通过计算发射红外信号与反射信号间的相位差,得到三维深度信息[2 ] .基于以上特点,ToF 相机可以应用在很多场景,如机器人视觉[3 ] 、三维重建[4 ] 、娱乐交互[5 ] 、及时定位与地图构建(SLAM)[6 ] 等. ...

Multi object detectio on in direct time-of-flight measurrements with SPADs

1

2018

... 近年来,飞行时间(time-of-flight,ToF)相机由于具有低成本、高精度、高可靠性和高帧率等优点[1 ] ,越来越受到人们的关注.ToF 相机通过计算发射红外信号与反射信号间的相位差,得到三维深度信息[2 ] .基于以上特点,ToF 相机可以应用在很多场景,如机器人视觉[3 ] 、三维重建[4 ] 、娱乐交互[5 ] 、及时定位与地图构建(SLAM)[6 ] 等. ...

Evaluation of deppth sensors for rrobotic application ns

1

2201

... 近年来,飞行时间(time-of-flight,ToF)相机由于具有低成本、高精度、高可靠性和高帧率等优点[1 ] ,越来越受到人们的关注.ToF 相机通过计算发射红外信号与反射信号间的相位差,得到三维深度信息[2 ] .基于以上特点,ToF 相机可以应用在很多场景,如机器人视觉[3 ] 、三维重建[4 ] 、娱乐交互[5 ] 、及时定位与地图构建(SLAM)[6 ] 等. ...

3D reconstruction wi ith time-of-flighht depth camera an nd multiple mirroors

1

2018

... 近年来,飞行时间(time-of-flight,ToF)相机由于具有低成本、高精度、高可靠性和高帧率等优点[1 ] ,越来越受到人们的关注.ToF 相机通过计算发射红外信号与反射信号间的相位差,得到三维深度信息[2 ] .基于以上特点,ToF 相机可以应用在很多场景,如机器人视觉[3 ] 、三维重建[4 ] 、娱乐交互[5 ] 、及时定位与地图构建(SLAM)[6 ] 等. ...

Facial expression recognition ada aptive to face ppose using RGB-D camera

1

2016

... 近年来,飞行时间(time-of-flight,ToF)相机由于具有低成本、高精度、高可靠性和高帧率等优点[1 ] ,越来越受到人们的关注.ToF 相机通过计算发射红外信号与反射信号间的相位差,得到三维深度信息[2 ] .基于以上特点,ToF 相机可以应用在很多场景,如机器人视觉[3 ] 、三维重建[4 ] 、娱乐交互[5 ] 、及时定位与地图构建(SLAM)[6 ] 等. ...

Hybrid Sensinng approach forr coded modulation n Time-of-Flight ccameras

1

2019

... 近年来,飞行时间(time-of-flight,ToF)相机由于具有低成本、高精度、高可靠性和高帧率等优点[1 ] ,越来越受到人们的关注.ToF 相机通过计算发射红外信号与反射信号间的相位差,得到三维深度信息[2 ] .基于以上特点,ToF 相机可以应用在很多场景,如机器人视觉[3 ] 、三维重建[4 ] 、娱乐交互[5 ] 、及时定位与地图构建(SLAM)[6 ] 等. ...

Time-of-flight annd structured ligght depth cameras

2

2016

... 然而,对于目前的ToF相机来说,飞行像素效应带来的深度估计误差是无法避免的,这给ToF相机的应用带来了巨大挑战[7 ] .因为ToF传感器的像素有一定的物理尺寸,所以每一个像素都可以接收到某一小块场景对应的距离信息.如果其中一块场景包含了物体边缘,那么深度量测值则是由不同距离的物体共同作用的.因此,飞行像素出现在不同深度物体的边缘处,如图1 所示. ...

... 通过计算ToF正弦回波信号与参考正弦信号的相位差,可以分别得到深度图和置信度图[7 ] ,具体的算法流程如图2 所示.该算法以测试场景(a)和测试场景(b)为例进行阐述. ...

Identiification and correc ction of flying pixe els in range camera data

1

2008

... 在过去几年中,人们在飞行像素校正方面做了很多研究.Sabov 等人[8 ] 采用固定深度阈值(fixed depth threshold,FDT)和线性分割的方法对飞行像素进行识别和校正.Zhang 等人[9 ] 通过设置浮动深度阈值(adaptive depth threshold,ADT)去除飞行像素,但对无效像素的滤除能力有限.在参考文献[10 ]中,一种自适应幅度阈值(adaptive amplitude threshold,AAT)方法被用于剔除错误像素,同时能够校正距离解析错误的低置信度像素.Mutto等人[11 ] 利用双目RGB测得的深度数据,对ToF传感器所测置信度图中较低部分的深度值进行了校正,可以有效解决无效像素的问题,但这种方法需要借助于其他测距设备. ...

Calibration aand gray-level imag ge generation ffoor the SR4500 TooF camera

1

2016

... 在过去几年中,人们在飞行像素校正方面做了很多研究.Sabov 等人[8 ] 采用固定深度阈值(fixed depth threshold,FDT)和线性分割的方法对飞行像素进行识别和校正.Zhang 等人[9 ] 通过设置浮动深度阈值(adaptive depth threshold,ADT)去除飞行像素,但对无效像素的滤除能力有限.在参考文献[10 ]中,一种自适应幅度阈值(adaptive amplitude threshold,AAT)方法被用于剔除错误像素,同时能够校正距离解析错误的低置信度像素.Mutto等人[11 ] 利用双目RGB测得的深度数据,对ToF传感器所测置信度图中较低部分的深度值进行了校正,可以有效解决无效像素的问题,但这种方法需要借助于其他测距设备. ...

A novel ap pproach to efficien tt error correction f for the Swiss Raanger time-of-flightt 3D camera

2

2008

... 在过去几年中,人们在飞行像素校正方面做了很多研究.Sabov 等人[8 ] 采用固定深度阈值(fixed depth threshold,FDT)和线性分割的方法对飞行像素进行识别和校正.Zhang 等人[9 ] 通过设置浮动深度阈值(adaptive depth threshold,ADT)去除飞行像素,但对无效像素的滤除能力有限.在参考文献[10 ]中,一种自适应幅度阈值(adaptive amplitude threshold,AAT)方法被用于剔除错误像素,同时能够校正距离解析错误的低置信度像素.Mutto等人[11 ] 利用双目RGB测得的深度数据,对ToF传感器所测置信度图中较低部分的深度值进行了校正,可以有效解决无效像素的问题,但这种方法需要借助于其他测距设备. ...

... 然后将FDT、AAT和ADT与本文所提算法进行性能对比,如图9 所示(深度值在右侧标出,单位为m m).A AT中的参数bwp 为置信度,由幅度计算得到[10 ] ,置信度与幅度之间只是常系数的差别,因此可以认为两者等价.文中bwp 为对距离To F相机1 m处白墙测距得到的置信度.AAT在处理周期缠绕错误时,表现通常很好,但是当其被应用于低反射率物体时,无法很好地识别有效深度数据,并且会引入许多噪声,如图9 (b)所示.尽管FDT在识别边缘方面性能更好,但是它无法区分有效像素和飞行像素,并且漏掉了大量无效像素,同时还引入了少量噪声.如图9 (c)所示,FDT对图像4个角落的噪声的鲁棒性较差.从图9 (d)可以看出ADT能够很好地识别飞行像素,并且在有效像素区域几乎不引入噪声,因此ADT对飞行像素的处理效果在几个对比算法中表现最好,但是对于无效像素的识别,ADT几乎没有起任何作用.与之相比,本文所提算法可以识别和校正大部分无效像素和飞行像素,同时引入非常少量的噪声,如图9 (e)所示.为了更直观地观察深度图效果,利用标定好的内参,可以将图9 (e)中的深度图转换为点云图,如图9 (f)所示. ...

Probabilist tic ToF and ster eo data fusion baseed on mixed pixelss measurement mo odels

1

2015

... 在过去几年中,人们在飞行像素校正方面做了很多研究.Sabov 等人[8 ] 采用固定深度阈值(fixed depth threshold,FDT)和线性分割的方法对飞行像素进行识别和校正.Zhang 等人[9 ] 通过设置浮动深度阈值(adaptive depth threshold,ADT)去除飞行像素,但对无效像素的滤除能力有限.在参考文献[10 ]中,一种自适应幅度阈值(adaptive amplitude threshold,AAT)方法被用于剔除错误像素,同时能够校正距离解析错误的低置信度像素.Mutto等人[11 ] 利用双目RGB测得的深度数据,对ToF传感器所测置信度图中较低部分的深度值进行了校正,可以有效解决无效像素的问题,但这种方法需要借助于其他测距设备. ...

A flexible new tec chnique for cameraa calibration

1

2000

... 通过利用深度图和置信度图,提出一种基于ToF相机的有效深度数据提取的方法.在解决上述问题时,默认ToF相机已完成标定[12 ] .一方面,为了区分有效像素和无效像素,首先使用基于核密度估计和连通域标记(connected component labeling, CCL)的自适应深度图像分割方法,将深度图分割为多个像素块,然后将一种改进的结构张量作为边缘检测器,最后利用投票操作决定每个像素块是被校正还是被剔除,从而得到深度图.另一方面,通过计算增强置信度,剔除那些不能提供足够置信度的像素,得到另外一幅深度图.最后计算2幅深度图的有效像素的交集,从而得到最终的深度数据. ...

Multtiple object trackinng based on adaptiv ve depth segmenntation

1

2008

... 图3 为测试场景(a)的深度图处理过程.测试场景(a)如图3 (a)所示,4个方纸盒分别放置于距ToF相机不同距离处,最远处白墙与ToF相机的距离为2.2 m.图3 (b)为中值滤波后的深度图(深度值在右侧标出,单位为m).在给定内参的条件下,可将二维深度图转换成三维点云,结果如图3 (c)所示,由椭圆和矩形框标识出的像素分别为飞行像素和无效像素.首先,应用基于核密度估计的图像分割方法[13 ] 将深度图按距离分割为多个像素块.核密度估计是一种用于估计随机变量概率密度函数的无参数估计方法.若给定核K(·)和带宽h,核密度估计可以表示为: ...

Connected co omponents for a fa ast and robust 2D LiDAR data seggmentation

1

2013

... 深度图像被分割后,应用一次扫描连通域标记算法处理每个距离段的像素块[14 ] .扫描顺序为从左到右、从上到下,初始化新的标签值 l=2.一次扫描连通域标记算法的步骤如下: ...

A fast operator for d detection and preci ise location of d istinct points,cornners and centers of circular features

1

1998

... 边缘检测用于尽可能多地识别无效像素和飞行像素,它决定了有效深度数据提取的性能.由于结构张量对噪声的鲁棒性较好,因此将其作为边缘检测器[15 ] .初始矩阵由深度图像 I J 0

Depth image interpolation n algorithm base ed on confidence map

1

2017

... 通过投票操作,可将飞行 像素和无效 像素区分开.如图5 所示,白色像素为待校正的飞行像素,橙色像素为需删除的无效像素.飞行像素的深度值可以用双三次方插值算法进行校正[16 ] . ...

Alignment by max ximization of mutuual informationn

1

1997

... 接下来对几种算法进行量化分析.由于 Sony SDK同样可生成最终深度图,且根据数据手册,测距精度小于1%,可通过其对同一场景测量的15帧深度图做平均,并将结果作为基准图像.然后基于互信息,分别用上述几种算法生成的深度图与其进行图像相似度度量[17 ] ,并进行比较.本次共对30个不同的室内场景进行测量,计算其与由 Sony 生成的深度图的相似度,并取平均值,结果见表1 . ...